Anthropisch / Benj Edwards

Am Donnerstag startete der KI-Hersteller und OpenAI-Konkurrent Anthropic Claude Pro, eine abonnementbasierte Version seines webbasierten KI-Assistenten Claude.ai, der ähnlich wie chatgpt funktioniert. Es ist für 20 $/Monat in den USA oder 18 Pfund/Monat in Großbritannien erhältlich und verspricht fünfmal höhere Nutzungslimits, vorrangigen Zugriff auf Claude in Zeiten mit hohem Datenverkehr und frühzeitigen Zugriff auf neue Funktionen, sobald diese auftauchen.

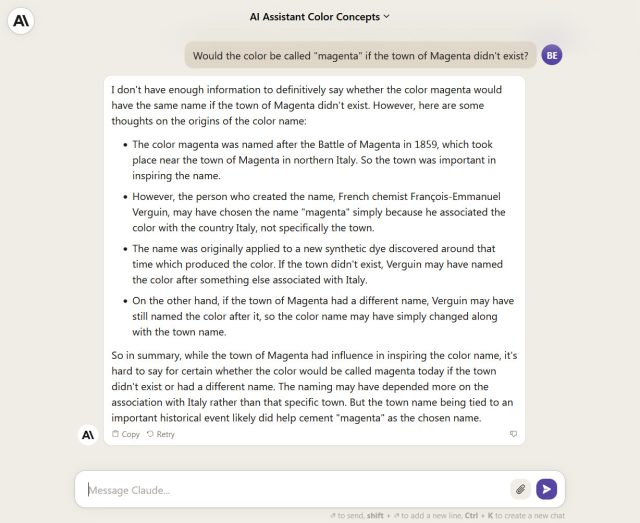

Wie ChatGPT kann Claude Pro Texte verfassen, zusammenfassen, Analysen durchführen, Logikrätsel lösen und mehr.

Claude.ai ist das, was Anthropic als Konversationsschnittstelle für sein KI-Sprachmodell Claude 2 anbietet, ähnlich wie ChatGPT einen Anwendungs-Wrapper für die zugrunde liegenden Modelle GPT-3.5 und GPT-4 bereitstellt. Im Februar entschied sich OpenAI für eine Abonnementroute für ChatGPT Plus, das für 20 US-Dollar pro Monat auch frühen Zugriff auf neue Funktionen ermöglicht, aber auch den Zugriff auf GPT-4 freischaltet, das leistungsstärkste Sprachmodell von OpenAI.

Was hat Claude, was ChatGPT nicht hat? Ein großer Unterschied ist ein Kontextfenster mit 100.000 Token, was bedeutet, dass etwa 75.000 Wörter gleichzeitig verarbeitet werden können. Token sind Wortfragmente, die bei der Textverarbeitung verwendet werden. Das bedeutet, dass Claude längere Dokumente analysieren oder längere Gespräche führen kann, ohne die Erinnerung an das jeweilige Thema zu verlieren. ChatGPT kann im GPT-4-Modus nur etwa 8.000 Token verarbeiten.

„Das Wichtigste für mich ist das 100.000-Token-Limit“, sagte KI-Forscher Simon Willison gegenüber Ars Technica. „Das ist riesig! Eröffnet völlig neue Möglichkeiten, und ich nutze es mehrmals pro Woche allein für diese Funktion.“ Willison regelmäßig schreibt darüber Er verwendet Claude in seinem Blog und er verwendet es oft, um Transkripte seiner persönlichen Vorträge zu bereinigen. Obwohl er auch vor „Halluzinationen“ warnt, bei denen Claude manchmal Dinge erfindet.

„Ich habe bei Claude definitiv auch mehr Halluzinationen gesehen“ als bei GPT-4, sagt Willison, „was mich nervös macht, wenn ich es für längere Aufgaben verwende, weil es so viel mehr Möglichkeiten gibt, dass es in etwas Halluziniertes hineinschlüpft, ohne dass ich es merke.“ „

Ars Technica

Willison hatte auch Probleme mit Claudes Moralfilter, der ihm versehentlich Probleme bereitete: „Ich habe versucht, ihn für die Transkription einer Podcast-Episode zu verwenden, und er hat den größten Teil des Textes vorher – direkt vor meinen Augen – verarbeitet löschte alles, was es getan hatte! Irgendwann wurde mir klar, worüber wir gesprochen hatten Bombendrohungen gegen Rechenzentren gegen Ende der Episode, und Claude wurde dadurch effektiv angefeuert und löschte das gesamte Transkript.“

Was bedeutet „5x mehr Nutzung“?

Das Hauptverkaufsargument von Anthropic für das Claude Pro-Abonnement ist „5x mehr Nutzung„, aber das Unternehmen kommuniziert nicht klar, wie hoch die Nutzungsbeschränkungen für die kostenlose Nutzung von Claude tatsächlich sind. Das Unternehmen hat Hinweise wie kryptische Brotkrümel fallen lassen und einen geschrieben Support-Dokument zu dem Thema, in dem es heißt: „Wenn Ihre Gespräche relativ kurz sind (ungefähr 200 englische Sätze, vorausgesetzt, Ihre Sätze bestehen aus etwa 15–20 Wörtern), können Sie damit rechnen, alle 8 Stunden mindestens 100 Nachrichten zu senden, oft auch mehr, abhängig von Claudes aktueller Kapazität.“ . Über zwei Drittel aller Gespräche auf claude.ai (Stand September 2023) fanden innerhalb dieser Länge statt.“

In einer anderen etwas kryptischen Aussage schreibt Anthropic: „Wenn Sie eine Kopie von hochladen Der große Gatsbykönnen Sie innerhalb von 8 Stunden möglicherweise nur 20 Nachrichten in dieser Konversation senden.“ Wir versuchen nicht zu rechnen, aber wenn Sie die genaue Wortanzahl von F. Scott Fitzgeralds Klassiker kennen, ist es möglicherweise möglich, Claudes tatsächliche Grenzen herauszufinden . Wir haben gestern Anthropic um Klarstellung gebeten und vor der Veröffentlichung keine Antwort erhalten.

In jedem Fall macht Anthropic deutlich, dass für ein KI-Modell mit einem Kontextlimit von 100.000 Token Nutzungsbeschränkungen erforderlich sind, da die damit verbundene Berechnung teuer ist. „Ein so leistungsfähiges Modell wie Claude 2 erfordert viele leistungsstarke Computer, insbesondere wenn es um die Beantwortung großer Anhänge und langer Gespräche geht“, schreibt Anthropic im Supportdokument. „Wir legen diese Grenzen fest, um sicherzustellen, dass Claude vielen Menschen zum kostenlosen Testen zur Verfügung gestellt werden kann, und um es Power-Usern zu ermöglichen, Claude in ihre täglichen Arbeitsabläufe zu integrieren.“

Außerdem wurde am Freitag Anthropic veröffentlicht Claude Instant 1.2, eine kostengünstigere und schnellere Version von Claude, die über eine API verfügbar ist. Allerdings ist es bei logischen Aufgaben weniger leistungsfähig als Claude 2.

Obwohl klar ist, dass große Sprachmodelle wie Claude interessante Dinge leisten können, scheinen ihre Nachteile und die Tendenz zur Konfabulation sie aus Gründen der Zuverlässigkeit von einer breiteren Verwendung abzuhalten. Dennoch ist Willison ein Fan von Claude 2 in seiner Online-Form: „Ich freue mich, dass es sich weiter verbessert. Das 100.000-Token-Ding ist ein riesiger Gewinn, und die Tatsache, dass man PDFs darauf hochladen kann, ist wirklich praktisch.“