Was du wissen musst

- Jimmy Wales, der Gründer von Wikipedia, äußerte kürzlich seine Bedenken hinsichtlich des KI-gestützten Tools von OpenAI, insbesondere hinsichtlich seiner Genauigkeit.

- Der Gründer erklärte, dass die Verwendung des Tools zum Generieren von Text auf der Plattform ein Chaos sei, da es schreckliche Arbeit leistete, da es die meisten Details falsch machte und sogar ungenaue Informationen lieferte.

- Wales hat die Möglichkeit, KI-Funktionen in Wikipedia zu nutzen, nicht völlig ausgeschlossen.

- Er betonte die Notwendigkeit eines KI-gestützten Tools, mit dem Ungenauigkeiten in Artikeln identifiziert werden können.

Die Integration generativer KI ist in verschiedenen Organisationen wie Microsoft auf einem Allzeithoch, insbesondere nach einer milliardenschweren Investition in die Technologie, die die Partnerschaft mit OpenAI verlängert hat.

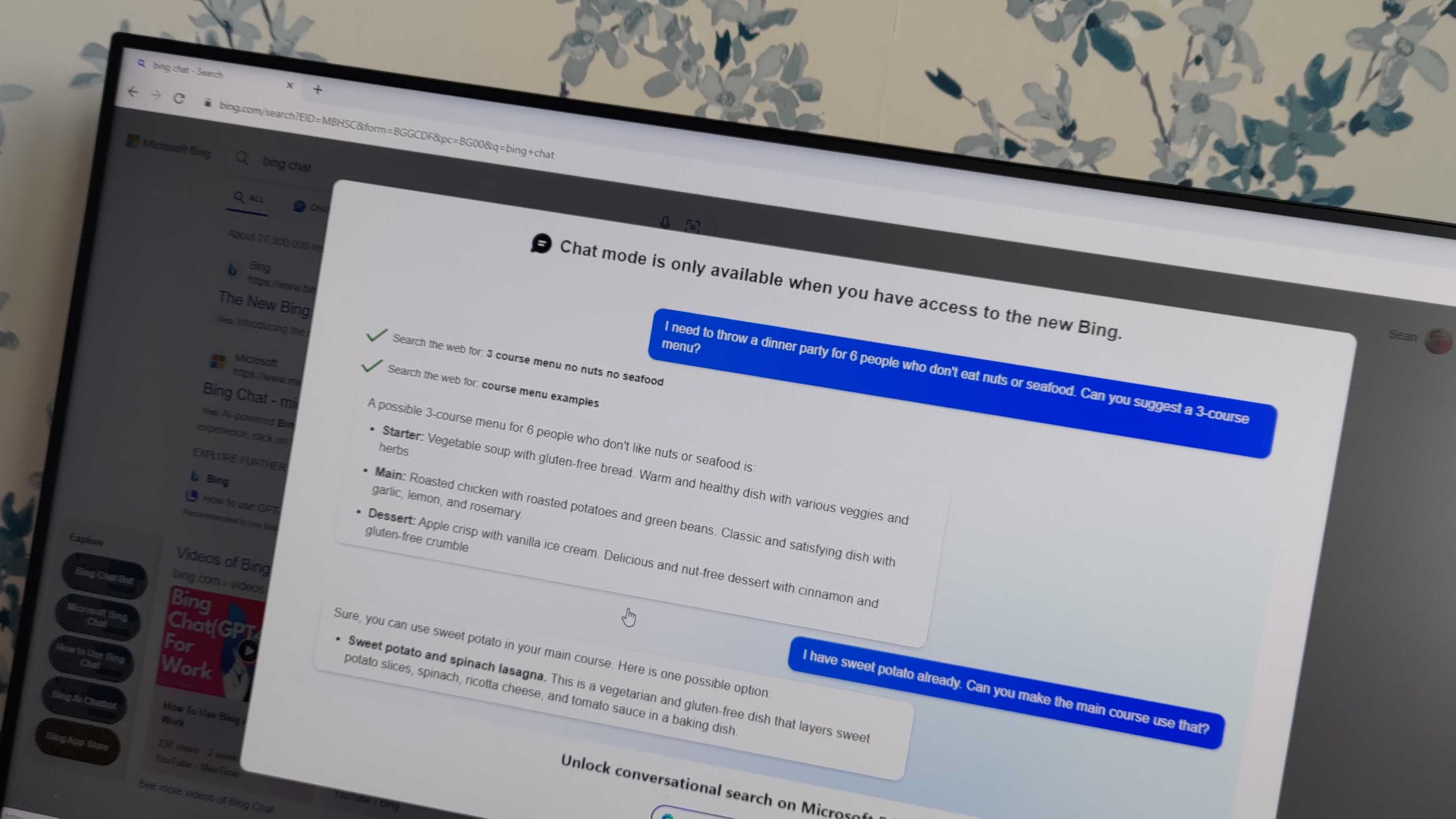

Infolgedessen hat dies zur Entstehung KI-gestützter Chatbots wie chatgpt von OpenAI und Copilot von Microsoft geführt. Diese Sprachmodelle können auf der Grundlage von Eingabeaufforderungen Text und Bilder generieren, komplexe mathematische Probleme lösen und vieles mehr. Einige Benutzer sind sogar noch einen Schritt weiter gegangen und haben versucht, mit ChatGPT ein ganzes Unternehmen zu leiten, das Software in weniger als 7 Minuten entwickeln kann.

Es besteht zwar kein Zweifel daran, dass die KI in den letzten Jahren in vielen Bereichen unglaubliche Leistungen erbracht hat, sie bringt aber auch einige Rückschläge mit sich. Der Gründer von Wikipedia, Jimmy Wales, wiederholte kürzlich in einem Gespräch mit Wikipedia die gleichen Ansichten Euro-Nachrichten.

ChatGPT könnte sich in einer Abwärtsspirale befinden

Wales beschrieb den Prozess der Nutzung des KI-gestützten Chatbots ChatGPT von OpenAI zum Schreiben von Artikeln auf Wikipedia als Chaos und verwies darauf, dass das Tool schrecklich sei und seine Aufgabe nicht erledige. Er fügte hinzu, dass das Tool beim Schreiben von Artikeln feine Details übersieht und manchmal etwas falsch macht, was an die Einführung von Microsoft Copilot erinnert, als mehrere Benutzer Beschwerden einreichten und Fälle anführten, in denen der Chatbot halluzinierte oder völlig falsche Antworten gab.

Die Bedenken von Wales hinsichtlich der Genauigkeit des Chatbots sind weder neu noch einzigartig. Im Juli enthüllte und zeigte eine Studie von Forschern, dass ChatGPT angesichts der Behauptungen, OpenAI stünde kurz vor dem Bankrott, immer dümmer wird.

Dies könnte die zunehmende Zahl von Beschwerden über KI-generierte Artikel mit ungenauen Informationen erklären, die relativ unsensibel wirken. Die jüngste war eine KI-generierte Umfrage, die in Microsoft Start (MSN) zusammen mit einem Artikel von The Guardian über den unglücklichen Tod einer jungen Frau veröffentlicht wurde und die Leser aufforderte, darüber abzustimmen, wie die Frau gestorben ist. Zu den weiteren Beispielen gehört ein von Microsoft veröffentlichter KI-generierter Artikel, in dem die Ottawa Food Bank als Top-Touristenattraktion in Kanada empfohlen wird. Nicht zu vergessen der KI-generierte Artikel, der über MSN erneut veröffentlicht wurde und im September viral ging, weil er einen verstorbenen 42-jährigen ehemaligen NBA-Spieler unverhohlen als „nutzlos“ bezeichnete.

Die Idee, dass Wikipedia KI-Fähigkeiten nutzt, ist nicht ganz vom Tisch

Auch wenn der Gründer von Wikipedia seine Vorbehalte gegenüber der Technologie zum Ausdruck gebracht hat, bedeutet dies nicht, dass die Möglichkeit, dass KI zur Verbesserung der auf der Plattform angebotenen Dienste eingesetzt wird, nicht in absehbarer Zukunft besteht.

Wales wies kategorisch darauf hin, dass es sehr hilfreich wäre, wenn ein KI-gestütztes Tool zur Verfügung gestellt würde, das dabei hilft, Fehler in Wikipedia-Artikeln zu erkennen, indem es auf die Originalquellen verweist. Er fügte hinzu, dass dies erheblich dazu beitragen würde, Ungenauigkeiten in den Artikeln zu reduzieren, und fügte hinzu, dass er bereit sei, mit einem Open-Source-Unternehmen für frei nutzbare KI zusammenzuarbeiten, um sich an die Prinzipien der Plattform anzupassen.

Die meisten Unternehmen, nicht nur Wohltätigkeitsorganisationen wie wir, würden sagen, dass Sie sehr, sehr vorsichtig sein müssen, wenn Sie eine Technologie in den Mittelpunkt Ihres Unternehmens stellen, die von jemand anderem kontrolliert wird, denn wenn jemand anderes in eine andere Richtung geht, wird Ihr Ganzes zerstört Das Geschäft könnte gefährdet sein.

Jimmy Wales, Wikipedia-Gründer

Wales weist darauf hin, dass, wenn Wikipedia KI aufgreift, die oberste Priorität darin bestehen wird, sicherzustellen, dass der in der Online-Enzyklopädie enthaltene Inhalt korrekt ist und auf die Originalquelle verweist. Seit dem Aufkommen der KI und ihrer Systeme gibt es einen langjährigen Kampf stehlen Nutzung von Inhalten von Websites ohne Quellenangabe.

Für OpenAI könnte Superintelligenz in Sicht sein

Wales prognostizierte, dass es bis zu 50 Jahre dauern würde, bis eine übermenschliche KI erreicht sei. Seltsamerweise könnte das Unternehmen inmitten des OpenAI-Fiaskoes, das letzte Woche nach der Entlassung von Sam Altman zu beobachten war, möglicherweise kurz vor einem Durchbruch stehen, der trotz seines frühen Stadiums eine positive Entwicklung in Richtung Superintelligenz zeigt.

Glauben Sie, dass der Hype um ChatGPT aufgrund der Ungenauigkeit und der allgemeinen Verschlechterung des Dienstes nachgelassen hat? Teilen Sie uns Ihre Gedanken in den Kommentaren mit.