apple scheint einen Pilottest der „chatgpt-ähnlichen“ Technologie gestartet zu haben, die von Kundendienstberatern des AppleCare Supports mit extrem hoher Geschwindigkeit für den professionellen Einsatz eingesetzt wurde. Weiterlesen Ein großes Upgrade für Siri? Apples enthüllte „ChatGPT-ähnliche“ KI-Funktion wurde stillschweigend in internen Berichtsinhalten verwendet.

▲Bildquelle: MacRumors

▲Bildquelle: MacRumors

Großes Siri-Upgrade? Apples enthüllte „ChatGPT-ähnliche“ KI-Funktion wurde intern stillschweigend genutzt

Der google Voice Assistant nebenan hat sich allmählich zur Bard/Gemini-Generation entwickelt, die die Leistungsfähigkeit großer Sprachmodelle einführt. Apples Siri-Sprachassistentenfunktion, die auf Neuigkeiten über die Entwicklung der künstlichen Intelligenz GAI gewartet hat, wird voraussichtlich vor der WWDC-Entwicklerkonferenz für verschiedene Gerätesysteme, einschließlich iOS/iPadOS, weiterentwickelt. Unerwartet scheint es, dass das Unternehmen in aller Stille Tests im Zusammenhang mit generativer KI und künstlicher Intelligenz für sehr „professionelle“ Bereiche gestartet hat.

Laut Nachrichten der ausländischen Medien MacRumors scheint Apple einen Pilottest der „ChatGPT-ähnlichen“ Technologie gestartet zu haben. Sehr ähnlich der Richtung ihres Spatial-Computing-Headsets Vision Pro verfügt dieser Satz von Tools, der offenbar „Ask“ heißt, über die Funktion, automatisch Antworten zu generieren. Bei seiner Einführung hieß er auch Pro und wurde direkt von AppleCare verwendet Unterstützen Sie Kundendienstberater. Nur für den professionellen Gebrauch bestimmt.

▲Bildquelle: MacRumors

▲Bildquelle: MacRumors

Es wird berichtet, dass das Ask-System von Apple in der Lage sein wird, die interne Kundendienst-Wissensdatenbank zusammenzufassen und zu organisieren, um Kundendienstberatern Antworten auf relevante Fragen zu geben. Beispielsweise kann ein Kundendienstberater Ask AI in natürlicher Sprache eine Frage stellen wie „Ein Kunde kann sein Gerät nicht auf iOS 13.7 aktualisieren. Was kann getan werden?“), um relevante Antworten zu erhalten.

Diese Funktion steht derzeit nur einer kleinen Anzahl von Mitarbeitern zur Verfügung, sollte aber je nach Reaktion auf den Test weiteren Beratern zur Verfügung gestellt werden. Es wird berichtet, dass Ask weiterhin bis zu 5 Fragen pro Anfrage stellen kann. Personen, die das System nutzen, können Antworten als „hilfreich/nicht hilfreich“ bewerten. Apple tendiert dazu, Kundendienstberater dazu zu ermutigen, über „Fragen“ nach Antworten zu suchen, wenn sie auf unbekannte Probleme stoßen, bevor sie leitende Berater fragen oder auf herkömmliche Weise die Wissensdatenbank des Kundendienstes durchsuchen.

▲Bildquelle:Mohamed Nohassi An Unsplash

▲Bildquelle:Mohamed Nohassi An Unsplash

Natürlich ist es wirklich eine nette Formulierung, diesen Ansatz „Professionalität beim Debüt“ zu nennen. Wenn man den Test auf diese Weise startet, habe ich persönlich den Eindruck, dass es ein wenig der Art und Weise ähnelt, wie Google interne Mitarbeiter gebeten hat, generative KI zu testen – dies geschieht nicht unbedingt, um Kosten zu sparen. Schließlich sollten Personen mit einem leichten beruflichen Hintergrund dazu in der Lage sein um schneller aufzuholen. Fehler, die bei der KI auftreten. Dies wirft jedoch auch Bedenken auf, dass professionelle Berater möglicherweise versehentlich falsche Informationen missverstehen und diese direkt an Kunden weitergeben.

Dieser Teil ist aus dem Bericht ersichtlich. Apple ist zu dem Schluss gekommen, dass die vom Ask-System zusammengestellten Daten aus einer festen Wissensdatenbank stammen und daher über ausreichende Authentizität und Benutzerfreundlichkeit sowie Rückverfolgbarkeit verfügen. Man sollte davon ausgehen, dass es die Leistung der Antworten bis zu einem gewissen Grad sicherstellen und sogar eine bessere Qualität und Effizienz des Kundenservice bieten kann.

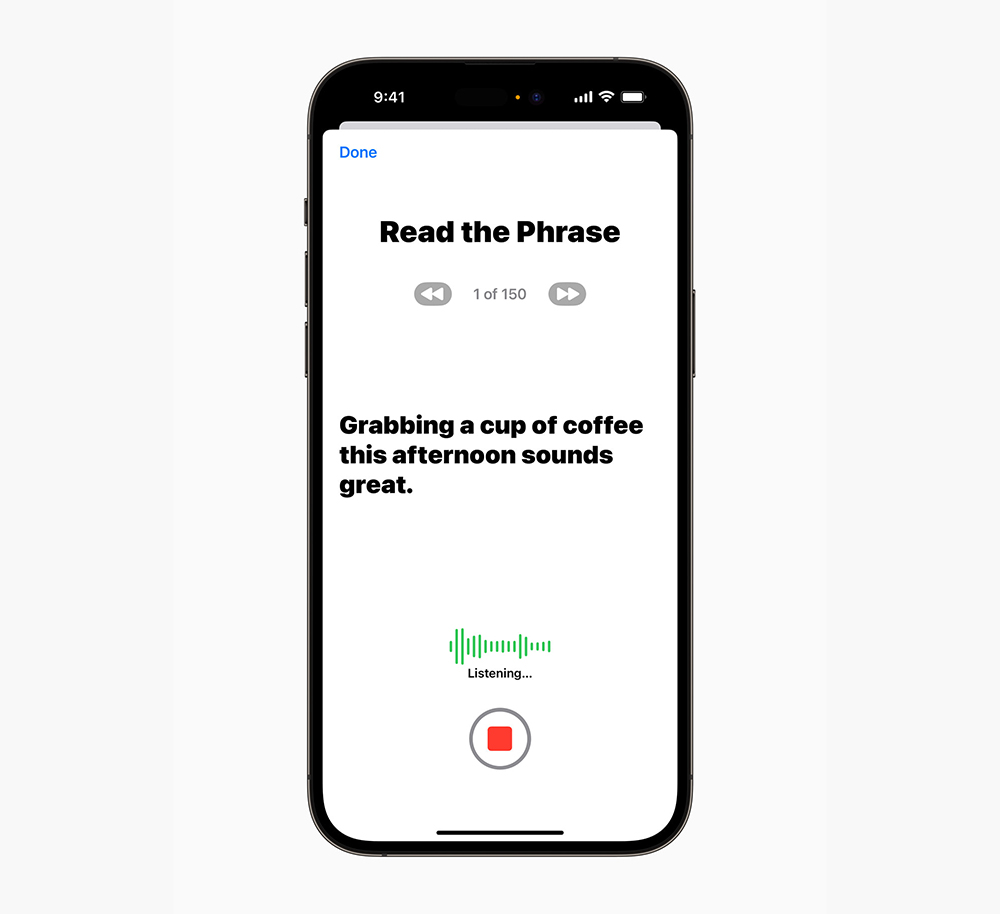

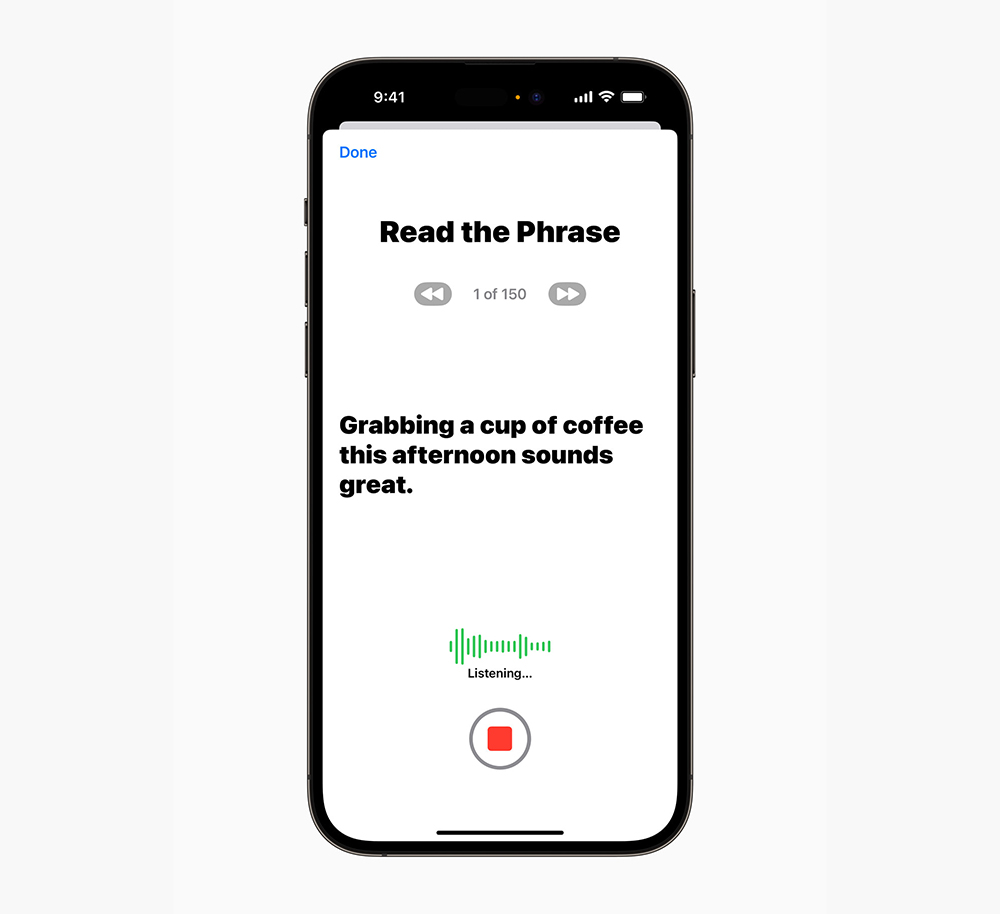

▲Bildquelle: Apple

Ob dieses als „ChatGPT-like“ bezeichnete System tatsächlich von Apple eingeführt wird, wie es in dem Bericht heißt. Ich glaube, dass das möglicherweise dahinter stehende groß angelegte Sprachmodell (Apple GPT?) wirklich gute Chancen hat, in nachfolgenden Apple-Gerätesystemen zum Einsatz zu kommen. Ich weiß nicht, ob es rechtzeitig in iOS 18 / iPadOS 18 hinzugefügt wird – die wichtigste Verbesserung, die die Hauptlast trägt, dürfte aber bei den zugehörigen Funktionen des Sprachassistenten „Siri“ liegen, oder?

Es wird auch vorhergesagt, dass, wenn Apple offiziell ein groß angelegtes generatives KI-Sprachmodell als Rückgrat des Ökosystems einführt, es sehr wahrscheinlich eine Reihe von Pages, Keynote, Numbers (sogar die iLife-Serie von GarageBand) einschließlich der iWork-Produktivitätssoftware direkt verbinden wird – eh, Erinnern Sie sich an iLife?) und Xcode-Anwendungen; Apple Music erhält möglicherweise auch Verbesserungen an entsprechenden Wiedergabelisten und Vorschlägen.

▲Bildquelle: Apple

▲Bildquelle: Apple

Es muss gesagt werden, dass die Einführung einer neuen Generation von KI tatsächlich ein riesiges Projekt ist, das den gesamten Körper betrifft, da Apple mittlerweile über ein so riesiges Software- und Hardware-Ökosystem verfügt. Es ist jedoch nicht richtig zu sagen, dass Apple zuvor überhaupt kein Layout für Anwendungen im Zusammenhang mit „generativer KI“ hatte.

Zumindest der aktuelle Eindruck des Autors ist, dass das iphone durch den internen Chip von Personal Voice nur 15 Minuten braucht, um die Stimme des Benutzers zu lernen. Außerdem gibt es eine „Point and Speak“-Funktion, die die präzise Objekterkennung von LiDAR mit einem Effekt ähnlich der AR-Gesteninteraktion kombiniert und es iPhone und iPad ermöglicht, die Richtung zu erkennen, in die der Finger gerade berührt, und den Text an der „gezeigten Stelle“ vorzulesen „Position mit Stimme. Tatsächlich nutzen sie alle ähnliche Technologien des maschinellen Lernens, um das Leben direkt zu verbessern und zu beeinflussen. Es ist eine gute Funktion, über die sich jeder mehr informieren sollte, während er sich auf iOS 18 freut.

Weiterführende Literatur:

Die ultratrendigen neuen Einsatzmöglichkeiten von Vision Pro wurden enthüllt: Nehmen Sie an der Veranstaltung „Spatial Computing Party“ teil