Nachrichten JVTech Apples KI ist offiziell geboren! Wenn Sie ein iphone besitzen, verwenden Sie nicht mehr chatgpt, sondern MM1, wie aus einem Forschungsartikel hervorgeht

Wir beginnen ernsthaft zu bezweifeln, dass apple bei der Entwicklung seiner künstlichen Intelligenz im Rückstand war. In einem Forschungsdokument zeigt die fruchtige Marke noch einmal diskret ihre enormen Ambitionen rund um KI und ein neues Sprachmodell. MM1 ist der Name und könnte viele Dinge auf dem iPhone verändern.

MM1 ist da, Apples neues Sprachmodell

Mach dir keine Sorgen, vSie haben weder eine Keynote von Apple noch eine große Ankündigung auf der Apple-Website verpasst. Obwohl die Marke gerade erst damit begonnen hat, den Begriff „KI“ in ihrer Kommunikation zu verwenden, scheint sie noch nicht bereit zu sein, ihn laut und deutlich zu offenbaren. Tatsächlich finden wir in einem bescheidenen Forschungsbericht interessante, aber vor allem recht präzise Informationen darüber Was Apple entwickelt: ein neues Sprachmodell.

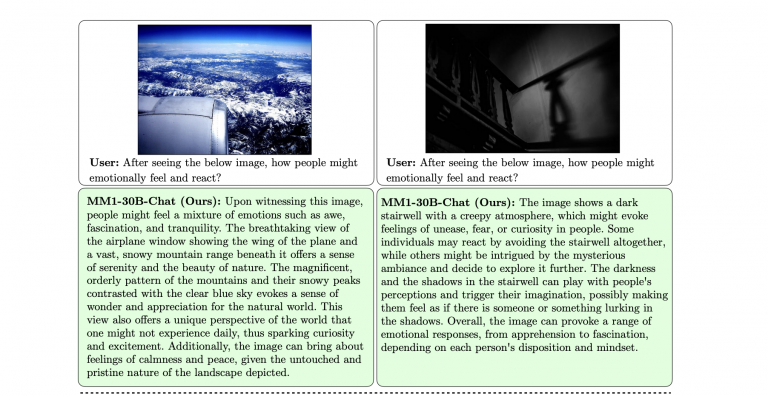

Wir wussten bereits, dass Apple an diesem Thema arbeitet, insbesondere mit Frettchen, ein Sprachmodell (LLM), das bis zu 13 Milliarden Parameter integriert. Ich war so überrascht, es auf diese Weise zu erfahren, und hier sind wir mit einer Sekunde Papier produziert von einem Team, das in einigen Fällen aus denselben Leuten besteht. Der Bericht beschreibt detailliert den Ansatz von MM1, der sich auf die Vielfalt der Datenquellen konzentriert, um eine flexiblere und intelligentere KI zu erreichen: Text, Bilder mit Beschreibung, Bilder allein, Bilder mit Text darin …

Ich freue mich, MM1! zu teilen. Die Modelle der MM1-Serie sind in jeder ihrer jeweiligen Modellgrößen mit Gemini 1 konkurrenzfähig. Wir kündigen nicht nur eine neue Modellreihe an, sondern teilen auch die Ablationsergebnisse mit, die unseren Forschungsprozess geleitet haben (🧵). pic.twitter.com/sYeJRDCbcP

— Brandon McKinzie (@mckbrando) 15. März 2024

Das Modell umfasst bis zu 30 Milliarden Parameter. und ist nun in der Lage, Bilder präziser zu interpretieren und eine komplexere Argumentationskette mit möglichst wenigen Daten zu entwickeln.

Dies ist kein Patent, wie es bei Apple fast jede Woche der Fall ist, und das bedeutet nicht unbedingt, dass jede Idee das Licht der Welt erblickt. Hier sehen wir deutlich, dass Tim Cook und sein Team viele Ideen haben, Schritt für Schritt voranschreiten und uns mit der Ankündigung des iPhone 16 überraschen könnten…

Eine superstarke KI im iPhone 16, die Siri ersetzt?

Diese Geschichten über KI, Daten und multimodale Benchmarks sind kompliziert, aber was könnte sich dadurch für uns arme Fischer ändern? Mit der Präsentation von Android-Smartphones, die von allen Seiten mit KI ausgestattet sind, Es ist mittlerweile schwer vorstellbar, dass Apple so viel Zeit und Ressourcen aufwenden würde, um das alles nicht in das iPhone zu integrieren.

Darüber hinaus hatten wir gerade erfahren, dass Apple mit google zusammenarbeiten würde, um Gemini in iPhones zu integrieren. Nichts ist sicher, aber selbst wenn dies wahr wäre, könnte es bedeuten, dass Apple immer noch die Gewässer mit dem anderen kalifornischen Unternehmen testet und gleichzeitig an seinem eigenen Modell arbeitet.

Die im Forschungsbericht aufgeführten Beispiele zeigen uns insbesondere die fortgeschrittene Interpretationsfähigkeit von MM1 im Umgang mit Bildern, Dies könnte es beispielsweise einer blinden Person ermöglichen, ihr iPhone zu verwenden, um zu wissen, welche Taste sie drücken muss, um ihren Kaffee zuzubereiten, oder sie könnte Siri einfach um viel ausgefeiltere Dinge bitten, wie zum Beispiel einen Chat-GPT im persönlichen Assistentenmodus.

Denn ja, es ist kaum zu glauben, dass Apple Siri aufgibt. Mit iOS 17.4, das es uns ermöglicht, einfach „Siri“ zu sagen, um es anzurufen, und ihm endlich weiterhin Fragen stellen zu können, ohne jedes Mal eine Anfrage neu zu starten, wird dies deutlich Das Unternehmen aus Cupertino glaubt an seinen Assistenten und sollte ihn, sofern es keine großen Überraschungen gibt, in den kommenden iPhone-Generationen komplett verändern.