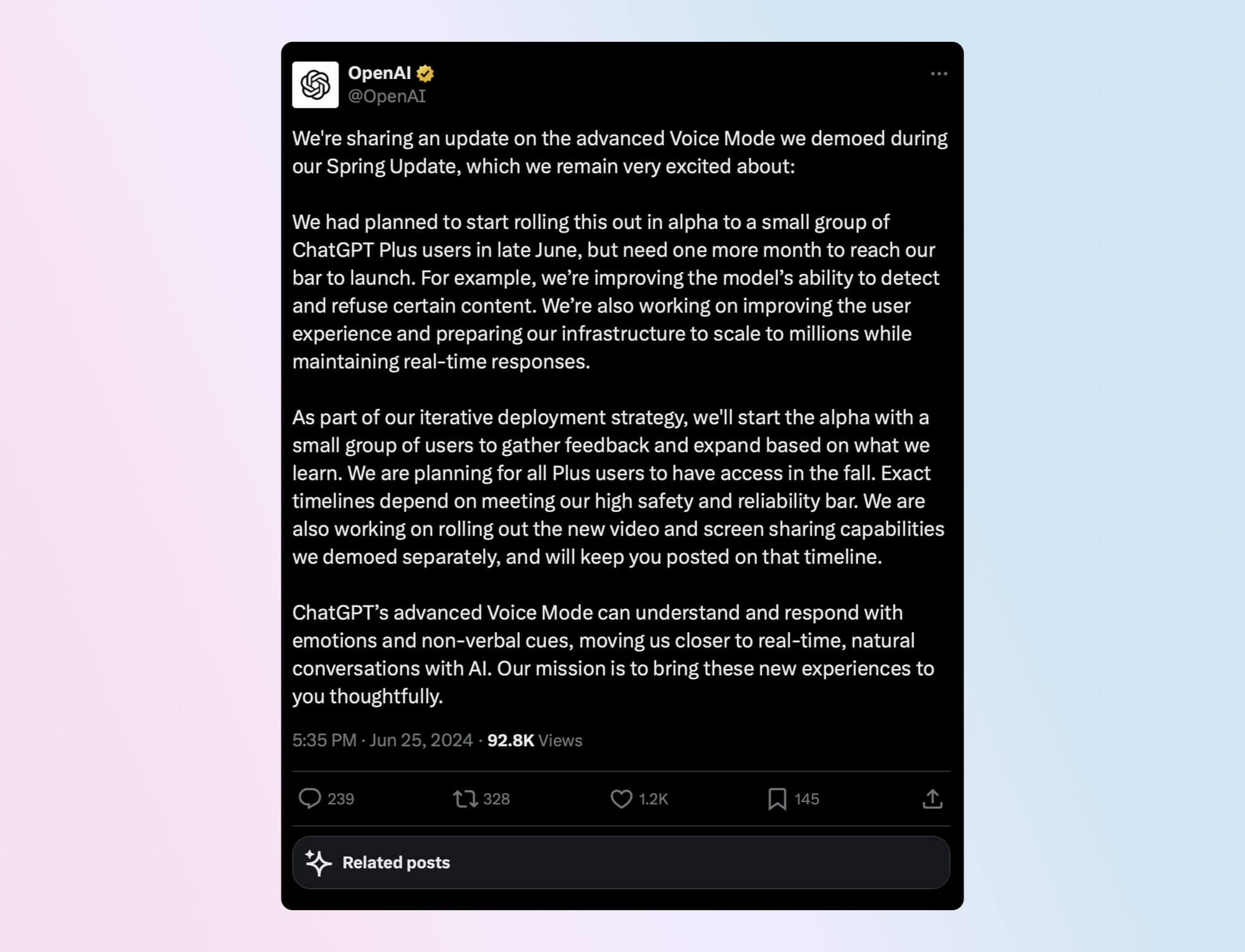

OpenAI verschiebt die Einführung des neuen erweiterten Sprachmodus von ChatGPT mit der Begründung, dass weitere Verbesserungen erforderlich seien. Das Unternehmen hatte geplant, diese Funktion Ende Juni einer kleinen Gruppe von ChatGPT Plus-Benutzern zur Verfügung zu stellen, sagt nun aber, dass es noch einen Monat braucht, um seine Standards zu erfüllen.

Der neue Advanced Voice Mode, der auf dem GPT-4o-Modell basiert, soll KI-Gespräche dem natürlichen menschlichen Dialog näher bringen. Als die Funktion letzten Monat bei OpenAIs Spring Update-Event vorgestellt wurde, demonstrierte sie die Fähigkeit, Emotionen und nonverbale Signale zu verstehen und darauf zu reagieren. Sie zeigte auch eine beeindruckende Geschwindigkeit mit Reaktionszeiten von nur 232 Millisekunden.

Die Verzögerung ist auf laufende Arbeiten in zwei Schlüsselbereichen zurückzuführen: Sicherheit und Benutzererfahrung. OpenAI möchte die Fähigkeit des Modells verbessern, bestimmte Arten von Inhalten zu erkennen und abzulehnen, um Missbrauch vorzubeugen und verantwortungsvolle KI-Interaktionen sicherzustellen. Außerdem konzentriert sich das Unternehmen darauf, die Benutzererfahrung zu verbessern und seine Systeme darauf vorzubereiten, Millionen von Benutzern zu bedienen und gleichzeitig Echtzeit-Reaktionen aufrechtzuerhalten.

Anfang des Monats berichteten wir über die Ankündigung einer neuen Partnerschaft zwischen OpenAI, Microsoft und Oracle, die es OpenAI ermöglichen wird, OCI zu nutzen, um die Microsoft Azure AI-Plattform zu erweitern. Dies wird wahrscheinlich eine große Rolle dabei spielen, ihnen die dringend benötigte Kapazität bereitzustellen, um den Zugriff auf ihre Modelle zu skalieren.

Trotz des Rückschlags bleibt OpenAI einem breiten Rollout verpflichtet. Sie planen, mit einer kleinen Alpha-Testgruppe zu beginnen und diese auf der Grundlage von Feedback schrittweise zu erweitern. Das Unternehmen geht weiterhin davon aus, dass alle ChatGPT Plus-Benutzer bis zum Herbst Zugriff haben werden, obwohl genaue Zeitpläne davon abhängen, ob die Sicherheits- und Zuverlässigkeitsstandards eingehalten werden.

Dieser vorsichtige Ansatz steht im Einklang mit dem wachsenden Bewusstsein der Branche für die Notwendigkeit einer verantwortungsvollen KI-Entwicklung. Da KI-Systeme immer fortschrittlicher und menschenähnlicher werden, wird es immer wichtiger, sicherzustellen, dass sie sicher und ethisch einwandfrei funktionieren.

Während ChatGPT bereits die neue multimodale GPT-4o Modell hat es nur Zugriff auf Bilder. OpenAI sagt, dass sie die Video- und Bildschirmfreigabefunktionen separat veröffentlichen werden, haben jedoch keine konkreten Zeitpläne angegeben.

Während einige Benutzer ihre Enttäuschung über die Verzögerung zum Ausdruck bringen, ist es sinnvoll, dass OpenAI sich darauf konzentriert, die Dinge vor dem Start richtig zu machen. Wenn der erweiterte Sprachmodus und die neuen multimodalen Funktionen verfügbar sind, wird es hoffentlich ein ausgefeilteres und sichereres Erlebnis sein.