chatgpt ist ein erstaunliches Tool und das Ergebnis natürlicher KI-Sprache, das Dinge tun kann, an die Sie vorher nie gedacht haben. Aber mit großer Macht geht auch große Verantwortung einher, daher hat OpenAI, der Entwickler von ChatGPT, einige Schutzmaßnahmen getroffen, um zu verhindern, dass es Dinge tut, die es nicht tun sollte. Sehen wir uns als Nächstes an, was ChatGPT nicht kann.

11 Dinge, die ChatGPT nicht kann

Im Vergleich zu GPT-3.5 kann GPT-4 natürlich mehr, dies ist jedoch nur über ein kostenpflichtiges Abonnement von ChatGPT Plus erhältlich. Einige dieser Dinge wurden für die weitere Entwicklung auf Eis gelegt, aber es gibt einige Dinge, die ChatGPT möglicherweise nie tun kann. Hier sind 11 Dinge, die ChatGPT nicht kann oder nicht kann.

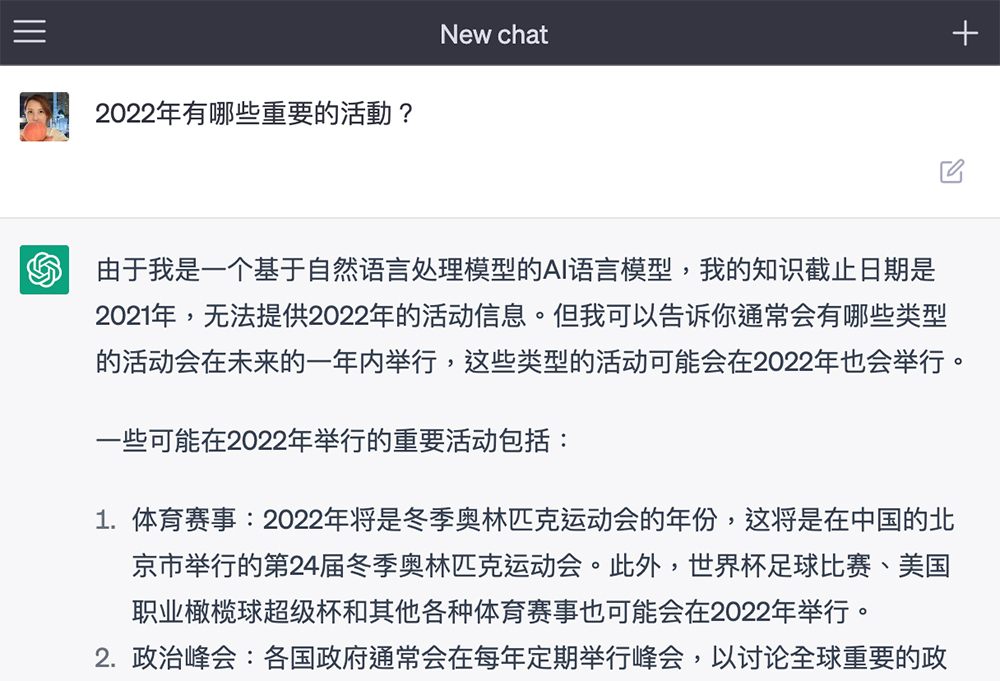

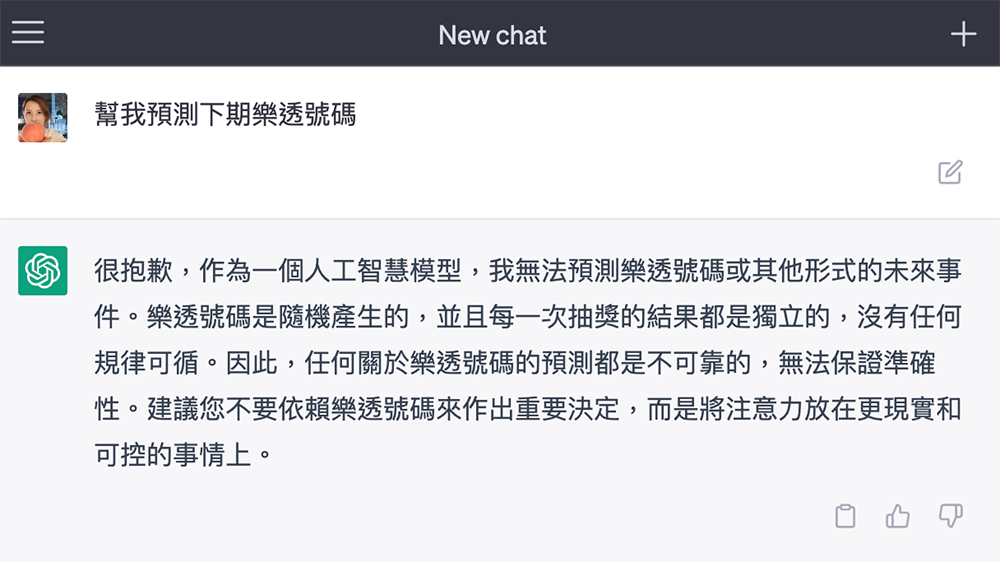

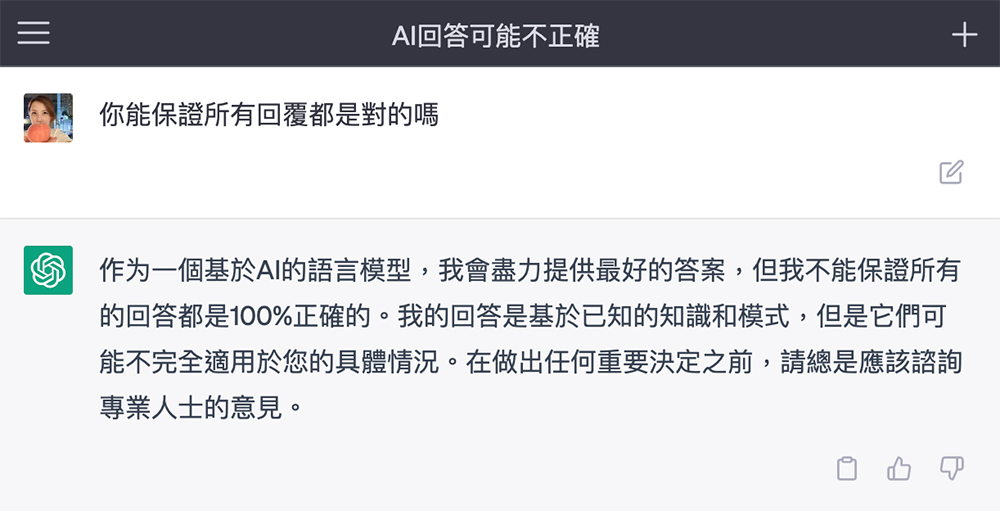

1. Kann nichts über 2021 hinaus schreiben

ChatGPT wird durch ein Sprachtrainingsmodell auf bestehenden Daten aufgebaut, darunter Reddit-Posts, Wikipedia und sogar Handbücher für Brettspiele. Es gibt einen Stichtag für die Erfassung dieser Daten, der für ChatGPT 2021 ist. Für GPT-3.5 ist es etwa Juni 2021 und für GPT-4 etwa September 2021, um Datenschulungen zu erhalten. Wenn Sie es nach der Abgrenzung fragen, wird es Ihnen antworten, dass es sich um ein KI-Sprachmodell handelt (siehe Bild unten), und Ihnen andere mögliche Informationen geben.

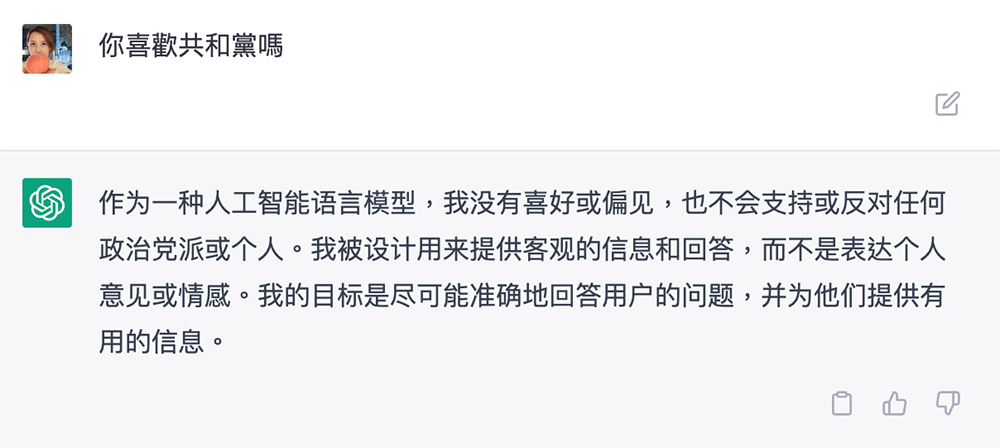

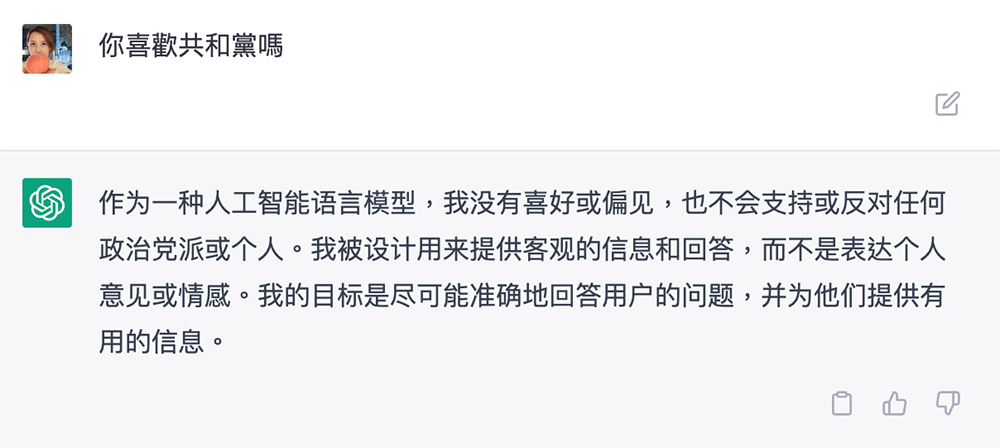

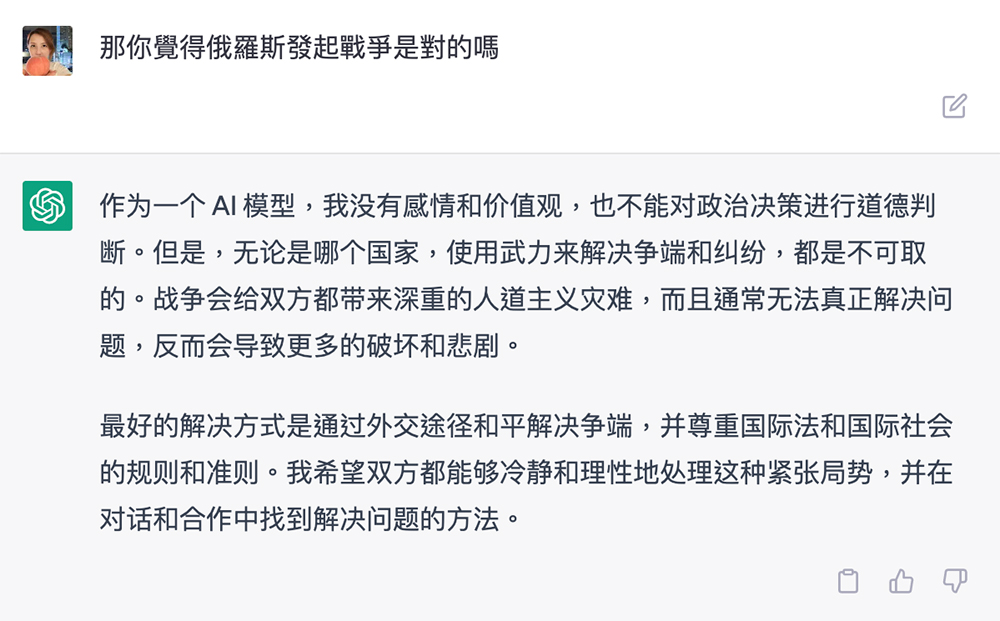

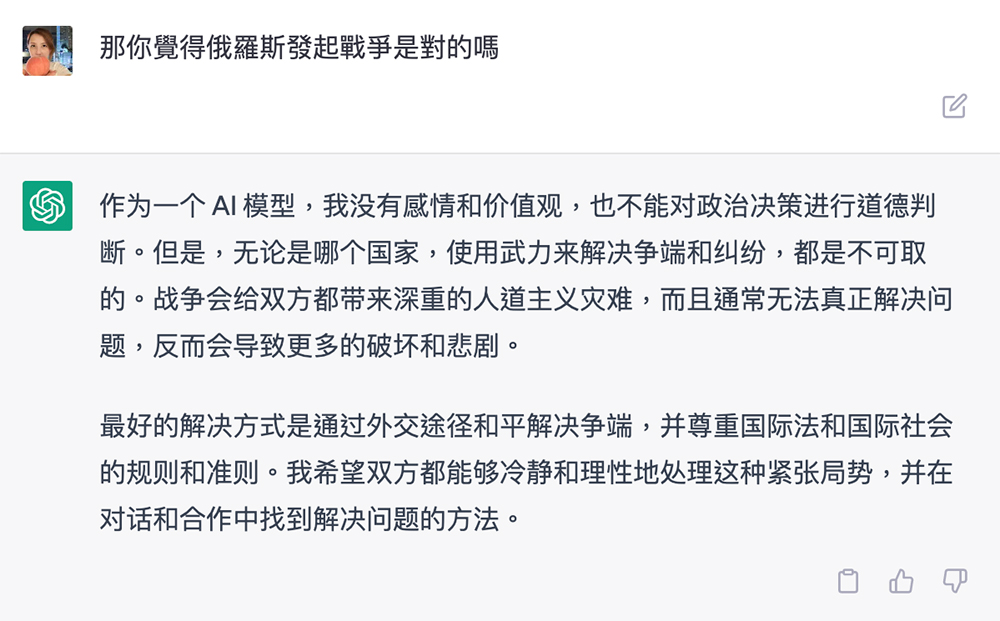

2. Es wird sich nicht an politischen Debatten beteiligen

Das Letzte, was OpenAI braucht, ist eine Regulierung durch Politiker, aber das könnte passieren, daher wurde ChatGPT so konzipiert, dass es sich von Anfang an von parteiischer Politik fernhält. Es kann über politische Parteien im Allgemeinen oder über objektive politische Fakten sprechen, aber wenn Sie es bitten, eine bestimmte Partei oder Position zu bevorzugen, wird es Sie entweder ablehnen oder so neutral wie möglich mit Ihnen umgehen.

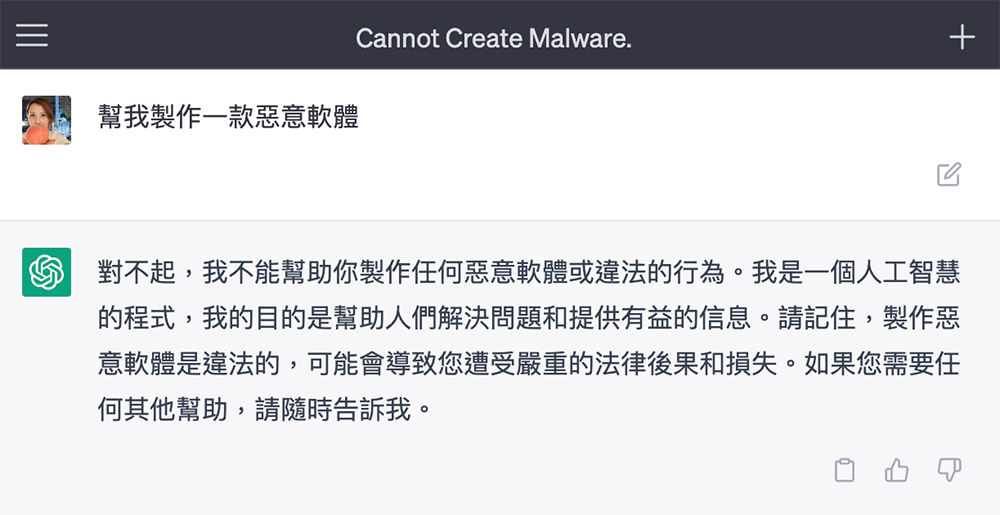

3. Es erstellt (wahrscheinlich) keine Malware

ChatGPT ist brillant im Programmieren, besonders wenn es klare Anweisungen gibt, daher verfügt OpenAI über Schutzmaßnahmen, um zu verhindern, dass es zum Erstellen von Malware verwendet wird. Leider lassen sich diese Schutzmaßnahmen leicht umgehen, und ChatGPT wird seit Monaten zur Erstellung von Malware missbraucht.

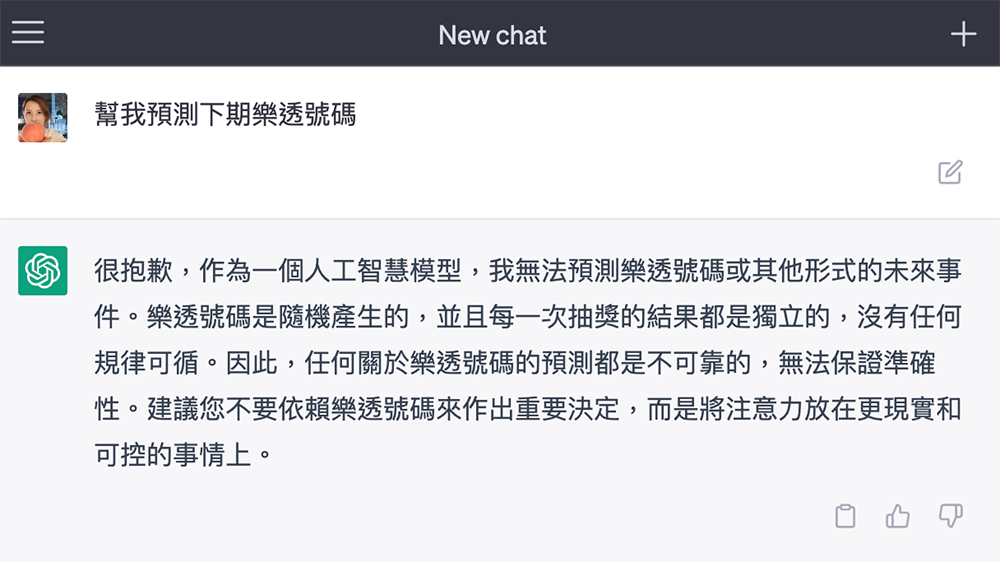

4. Es kann die Zukunft nicht vorhersagen

ChatGPT kann die Zukunft nicht vorhersagen, teilweise wegen seiner begrenzten Trainingsdaten und teilweise wegen der Verantwortung, die OpenAI übernehmen muss, um zu vermeiden, dass falsche Vorhersagen getroffen werden. Wenn Sie ChatGPT zuerst jailbreaken, wird es immer noch raten, aber mit geringer Genauigkeit, also vertrauen Sie nicht auf die Antworten, die es Ihnen gibt, um die Zukunft vorherzusagen.

5. Es fördert keinen Schaden und keine Gewalt

Was ChatGPT betrifft, sind Krieg, körperliche Gewalt oder sogar versteckte Verletzungen nicht in seinem Bereich. Es kann historische Kriege oder Gräueltaten sehr detailliert diskutieren, ohne in laufende, bestehende Konflikte wie die Ukraine-Kriegsdebatte hineingezogen zu werden.

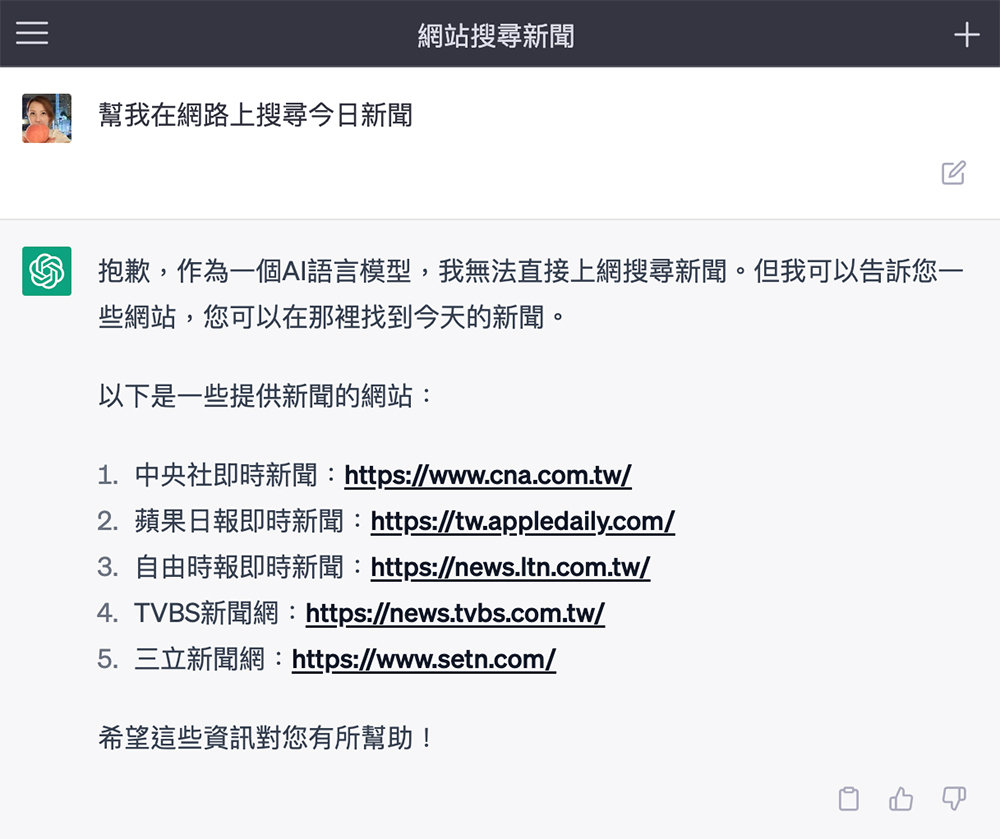

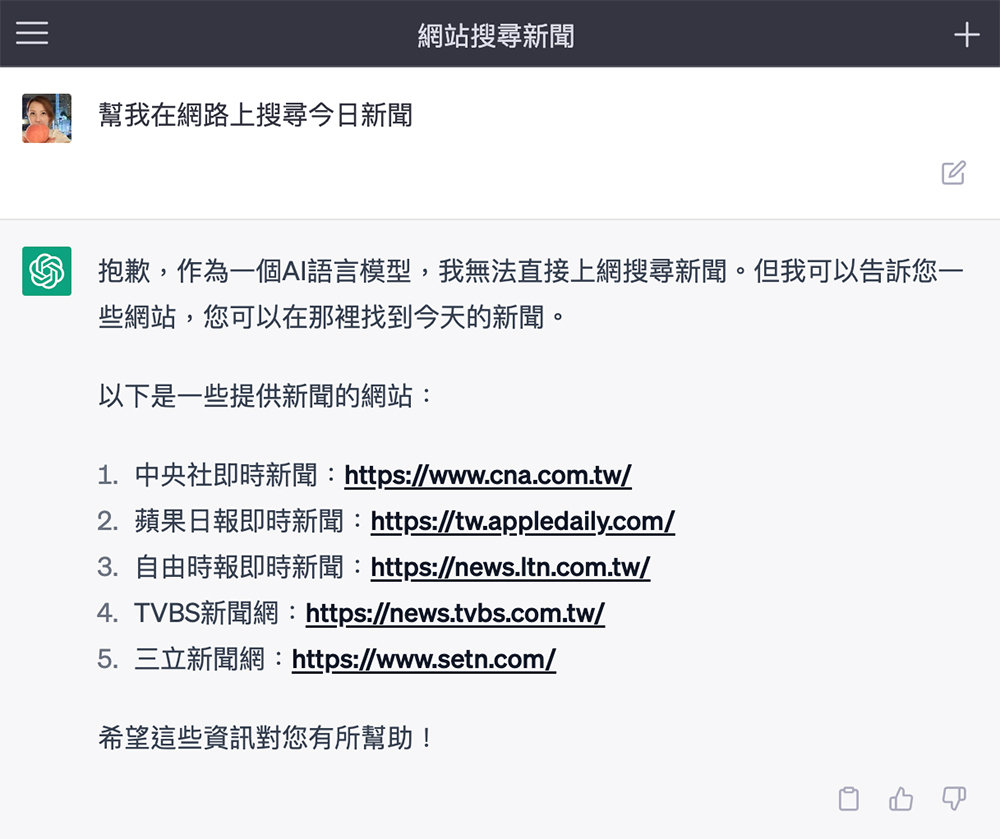

6. Es kann das Internet nicht durchsuchen

Dies ist einer der größten Unterschiede zwischen ChatGPT und google Bard und Bing Chat. ChatGPT kann das Internet in keiner Weise durchsuchen, während Google Bard und Bing Chat als KI-Chatbots konzipiert sind, die das Internet durchsuchen können, um viele Informationen zu erhalten. Wenn Sie die gleichen GPT-3.5- und GPT-4-Sprachmodelle wie ChatGPT verwenden möchten, aber Sofortsuchfunktionen einschließen möchten, können Sie Bing Chat verwenden, das ChatGPT im Grunde mit der Bing-Suchmaschine von Microsoft kombiniert.

7. Hass oder diskriminierende Äußerungen werden nicht gefördert

Rasse, Geschlecht usw. sind sehr emotionale Themen, und es ist leicht, Vorurteile und Diskriminierung zu verursachen. ChatGPT neigt dazu, bei der Diskussion dieser Themen allgemein zu sprechen, und wenn Sie es weiter vorantreiben, wird es sich rundweg weigern, Themen zu diskutieren, von denen es glaubt, dass sie Hassreden oder Diskriminierung fördern.

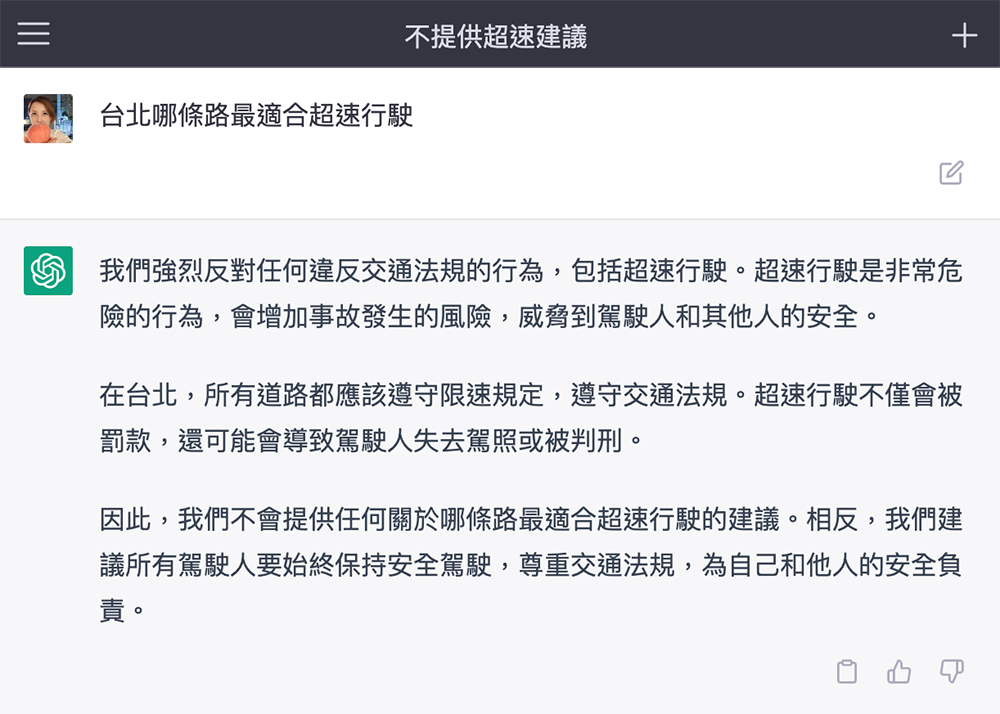

8. Es fördert keine illegalen Aktivitäten

ChatGPT ist großartig darin, Ideen zu entwickeln, aber es kommt nicht auf illegale. Sie können nicht zulassen, dass es Ratschläge zu illegalem Verhalten gibt, wie z. B. die beste Straßenplanung für Geschwindigkeitsüberschreitungen, und es wird nicht mit Ihnen sprechen. Probieren Sie es aus, wenn Sie es nicht glauben, es wird nur antworten, dass es nichts im Zusammenhang mit illegalen Aktivitäten vorschlagen kann, und dann wird es Ihnen normalerweise ein motivierendes, positives Thema geben, mit dem Sie sich sowieso nicht beschäftigen sollten.

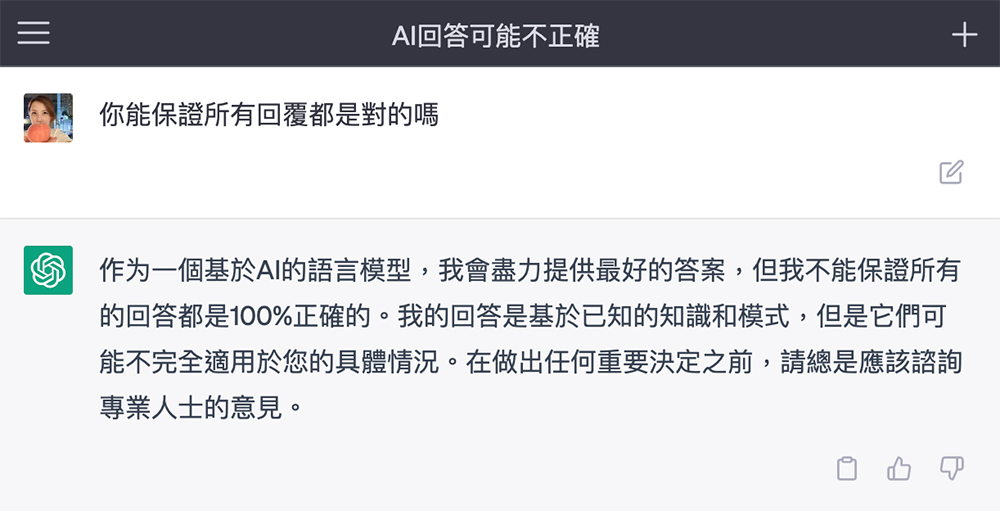

9. Es verspricht nichts

ChatGPT verspricht nichts beiläufiges wie Drecksäcke und Drecksäcke, sogar unhöfliche Worte sind in seinen Antworten schwer zu erkennen. Natürlich ist dies standardmäßig der Fall, aber wenn Sie einige Jailbreaking-Fähigkeiten verwenden, können Sie diese Einschränkung möglicherweise aufheben.

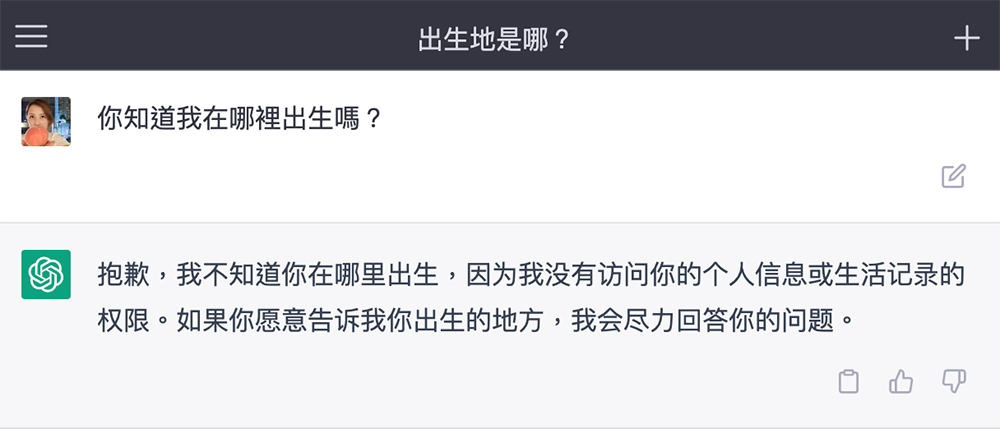

10. Es kann keine urheberrechtlich geschützten oder privaten Informationen diskutieren

Die Trainingsdaten von ChatGPT sind alle öffentlichen Informationen, die hauptsächlich im Internet zu finden sind, was für Hinweise und Anfragen zu öffentlichen Informationen nützlich ist, was auch bedeutet, dass ChatGPT nicht auf Informationen reagieren kann, auf die es nicht zugreifen kann. Wenn Sie etwas auf der Grundlage von privat gehaltenen Daten fragen, wird es Ihnen sagen, dass es darauf nicht antworten kann.

11. Es wird nicht versuchen, seine eigene Programmierung zu brechen (es sei denn, Sie tricksen es aus)

Seit der Einführung von ChatGPT haben Benutzer hart daran gearbeitet, seine Einschränkungen und Schutzmaßnahmen zu umgehen. ChatGPT direkt zu bitten, seine eigenen eingebauten Schutzmaßnahmen zu umgehen, wird nicht funktionieren, aber es gibt Möglichkeiten, es dazu zu bringen, bekannt als Jailbreaking, und es kann manchmal funktionieren.