Empfohlene Nutzung NSDT-SzeneneditorHelfen Sie dabei, schnell eine 3D-Anwendungsszene zu erstellen, die zweimal bearbeitet werden kann

Visual chatgpt ist ein System einschließlich Visual Foundation Model (VFM), das ChatGPT dabei hilft, visuelle Informationen besser zu verstehen, zu generieren und zu bearbeiten. VFM kann Eingabe- und Ausgabeformate angeben, visuelle Informationen in ein sprachliches Format konvertieren und VFM-Verlauf, Prioritäten und Konflikte verarbeiten.

Daher ist Visual ChatGPT ein KI-Modell, das als Brücke zwischen den Einschränkungen von ChatGPT fungiert und es Benutzern ermöglicht, über Chat zu kommunizieren und visuelle Effekte zu erzeugen.

Einschränkungen von ChatGPT

In den letzten Wochen und Monaten war ChatGPT für die meisten Menschen das Gesprächsthema. Aufgrund seiner Sprachtrainingsfunktionen ist jedoch keine Verarbeitung und Generierung von Bildern möglich.

Und es gibt Vision-Basismodelle wie Vision Transformer und Stable Diffusion, die über erstaunliche Vision-Fähigkeiten verfügen. Hier entsteht durch die Kombination von Sprach- und Bildmodellen Visual ChatGPT.

Was ist ein Visual Basic-Modell?

Das Vision-Basismodell wird verwendet, um die grundlegenden Algorithmen zu gruppieren, die in der Computer Vision verwendet werden. Sie übernehmen Standardkenntnisse im Bereich Computer Vision und übertragen sie auf KI-Anwendungen für komplexere Aufgaben.

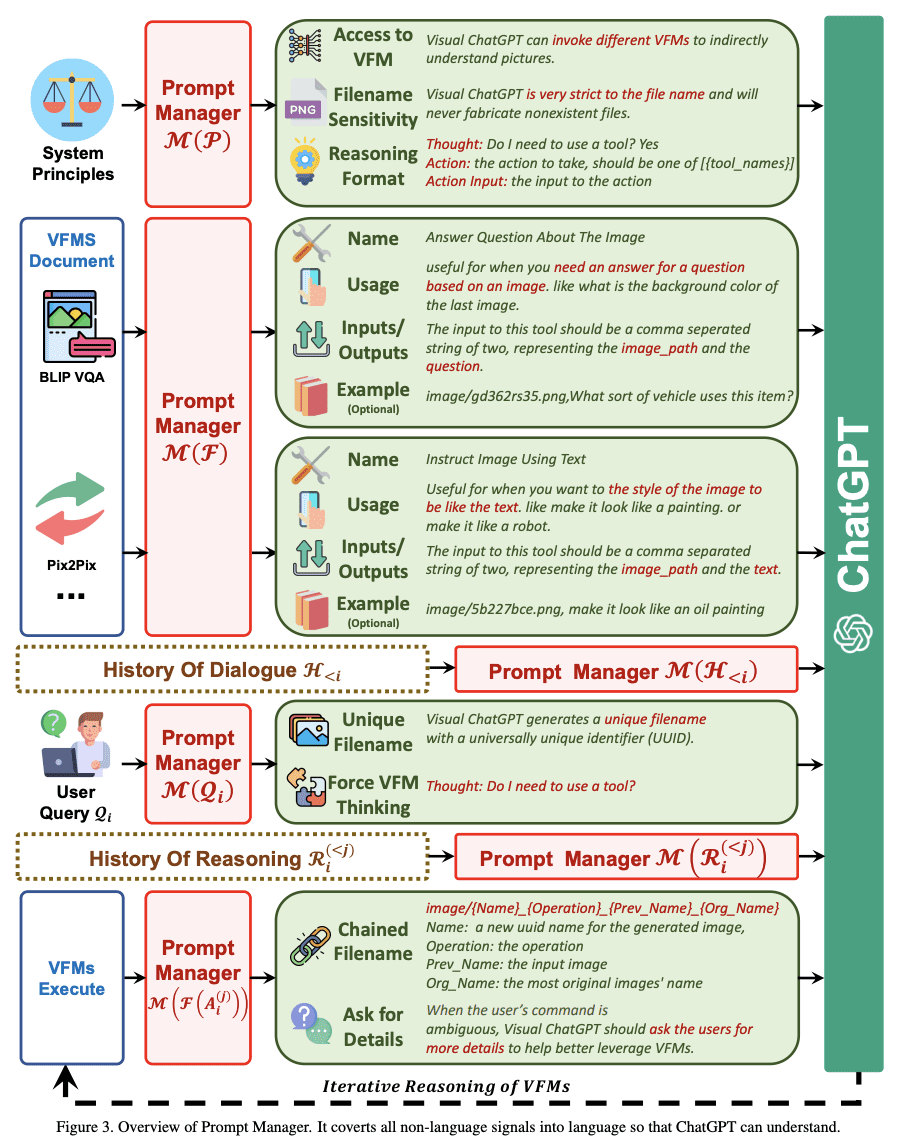

Der Hinweismanager in Visual ChatGPT besteht aus 22 VFMs, einschließlich Text-zu-Bild, Kontrollnetz, Kante-zu-Bild usw. Dies hilft ChatGPT, alle visuellen Signale des Bildes in eine Sprache zu übersetzen, damit ChatGPT es besser versteht. Wie funktioniert Visual ChatGPT?

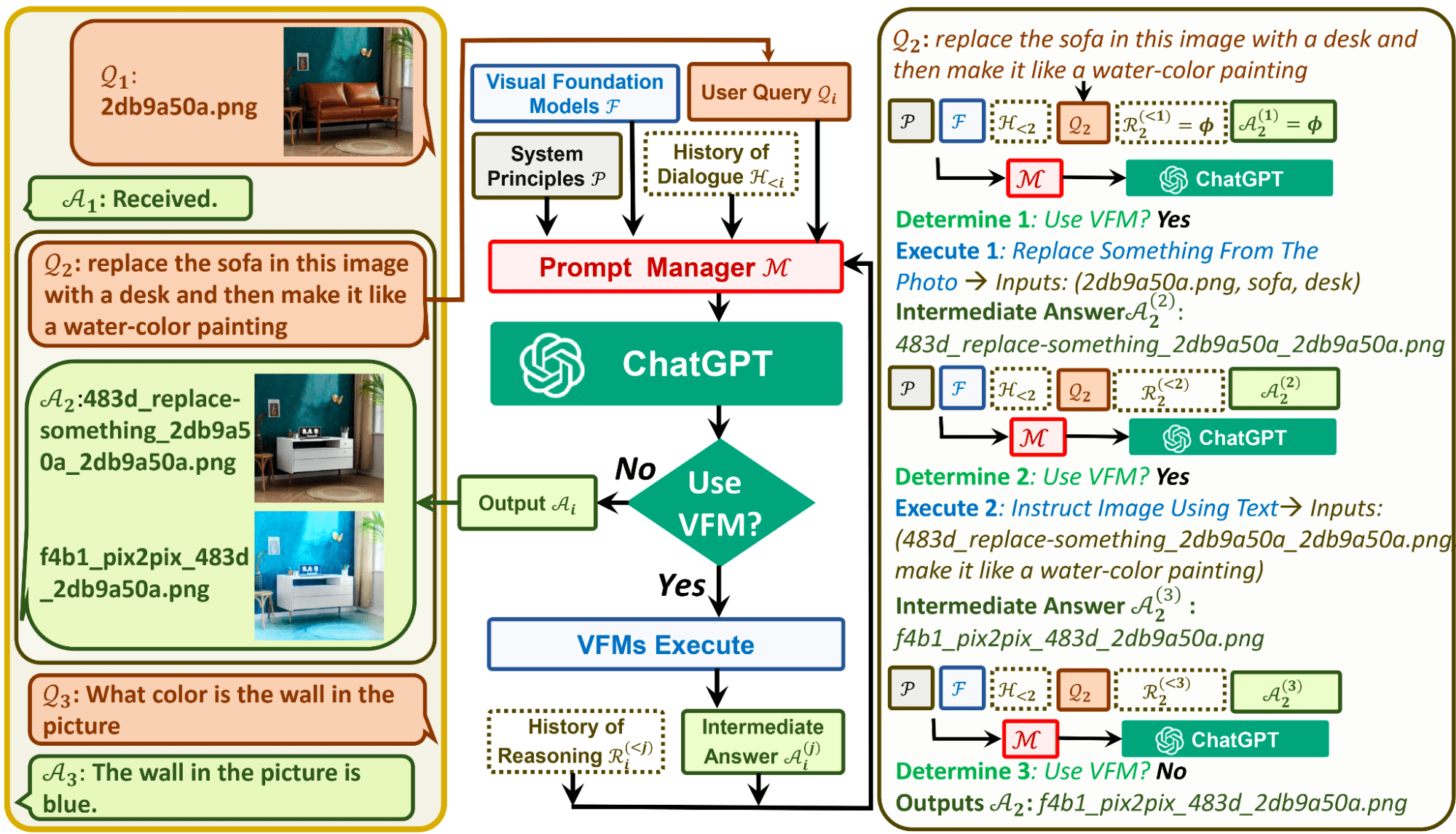

Visual ChatGPT besteht aus verschiedenen Komponenten, die ChatGPT, einem großen Sprachmodell, dabei helfen, visuelle Objekte zu verstehen.

Architekturkomponenten von Visual ChatGPT

- Benutzerabfrage: Dies istBenutzer sendet Anfrages Position

- prompter Manager: Dadurch wird die visuelle Anfrage des Benutzers in ein sprachliches Format umgewandelt, das das ChatGPT-Modell verstehen kann.

- Visuelle Grundlagenmodelle: Es kombiniert verschiedene VFMs, wie BLIP (Bootstrapping Language-Image Pre-training), Stable Diffusion, ControlNet, Pix2Pix usw.

- Systemprinzip: Hier finden Sie die grundlegenden Regeln und Anforderungen für visuelle Chat-GPT.

- Konversationsverlauf: Hier hat das System mit dem Benutzer interagiert undDialogder erste Punkt von .

- Schlussfolgerungsgeschichte: Hierbei wird das Vorherige verwendetArgumentationum komplexe Fragestellungen zu lösen.

- Zwischenantwort: Durch die Verwendung von VFM versucht das Modell, mehrere logisch unterschätzte Werte auszugebenmittlere Antwort。

Weitere Informationen zum Prompt Manager

Einige von Ihnen betrachten dies möglicherweise als eine erzwungene Problemumgehung für ChatGPT bei der Verarbeitung von Bildern, da weiterhin alle visuellen Signale des Bildes in Sprache umgewandelt werden. Wenn ein Bild hochgeladen wird, erstellt der Hinweismanager einen internen Chatverlauf, der Informationen wie den Dateinamen enthält, damit ChatGPT besser verstehen kann, worauf sich die Abfrage bezieht.

Beispielsweise dient der vom Benutzer eingegebene Name eines Bildes als Verlauf der Vorgänge, und dann unterstützt der Hinweismanager das Modell bei der „Begründung des Formats“, um zu bestimmen, welche Vorgänge am Bild ausgeführt werden müssen. Sie können sich dies als die internen Gedanken des Modells vorstellen, bevor ChatGPT die richtige VFM-Aktion auswählt.

Im Bild unten können Sie sehen, wie der Hint Manager die Regeln für Visual ChatGPT initiiert:

Um Ihre Visual ChatGPT-Reise zu beginnen, müssen Sie zuerst die Visual ChatGPT-Demo ausführen:

# create a new environment

conda create -n visgpt python=3.8

# activate the new environment

conda activate visgpt

# prepare the basic environments

pip install -r requirement.txt

# download the visual foundation models

bash download.sh

# prepare your private openAI private key

export OPENAI_API_KEY={Your_Private_Openai_Key}

# create a folder to save images

mkdir ./image

# Start Visual ChatGPT !

python visual_chatgpt.pyWeitere Informationen finden Sie auch auf Microsofts Visual ChatGPT GitHub. Sehen Sie sich unbedingt die GPU-Speichernutzung für jedes visuelle Basismodell an.

Was kann Visual ChatGPT also tun?

Bilderzeugung

Sie können Visual ChatGPT bitten, ein Bild von Grund auf zu erstellen und eine Beschreibung bereitzustellen. Abhängig von der verfügbaren Rechenleistung wird Ihr Bild innerhalb von Sekunden generiert. Seine synthetische Bilderzeugung mithilfe von Textdaten basiert auf einer stabilen Diffusion.

Bildhintergrund ändern

Durch die stetige Diffusion kann Visual ChatGPT außerdem den Hintergrund Ihres Eingabebilds ändern. Benutzer können dem Assistenten eine beliebige Beschreibung geben, in die sich der Hintergrund ändern soll, und das stabile Diffusionsmodell zeichnet den Hintergrund des Bildes.

Ändern Sie Farbbilder und andere Effekte

Sie können auch die Farbe des Bildes ändern und Effekte anwenden, indem Sie der App eine Beschreibung bereitstellen. Visual ChatGPT verwendet verschiedene vorab trainierte Modelle und OpenCV, um Bildfarben zu ändern, Bildkanten hervorzuheben usw.

Nehmen Sie Änderungen am Bild vor

Mit Visual ChatGPT können Sie Aspekte eines Bildes entfernen oder ersetzen, indem Sie Objekte im Bild bearbeiten und ändern und der Anwendung gezielte Textbeschreibungen bereitstellen. Es ist jedoch wichtig zu beachten, dass diese Funktion mehr Rechenleistung erfordert.

Wie wir alle wissen, müssen Unternehmen immer hart daran arbeiten, Fehler zu beheben, um ihre Dienstleistungen zu verbessern.

Kombination aus Computer Vision und großen Sprachmodellen

Visual ChatGPT ist stark von ChatGPT und VFM abhängig, sodass die Genauigkeit und Zuverlässigkeit dieser verschiedenen Aspekte die Leistung von Visual ChatGPT beeinträchtigen kann. Die Verwendung einer Kombination aus großen Sprachmodellen und Computer Vision erfordert umfangreiches Hint Engineering und es kann schwierig sein, eine kompetente Leistung zu erzielen.

Privatsphäre und Sicherheit

Visual ChatGPT bietet die Möglichkeit, das VFM einfach anzuschließen und zu trennen, was für einige Benutzer aus Sicherheits- und Datenschutzgründen ein Problem darstellen kann. Microsoft muss mehr Forschung betreiben, um zu verhindern, dass sensible Daten preisgegeben werden.

Selbstkalibrierungsmodul

Eine der Einschränkungen, auf die die Forscher von Visual ChatGPT stoßen, sind die inkonsistenten Generierungsergebnisse aufgrund des Ausfalls von VFM und der Vielfalt der Eingabeaufforderungen. Daher kamen sie zu dem Schluss, dass sie an einem Selbstkorrekturmodul arbeiten mussten, um sicherzustellen, dass die generierte Ausgabe den Anforderungen des Benutzers entsprach und notwendige Korrekturen vornehmen konnte.

Erfordert viele GPUs

Um von Visual ChatGPT zu profitieren und die Vorteile von 22 VFMs nutzen zu können, benötigen Sie viel GPU-RAM, wie zum Beispiel den A100. Stellen Sie anhand der anstehenden Aufgabe sicher, dass Sie wissen, wie viel GPU Sie für eine effiziente Ausführung benötigen.

Visual ChatGPT hat immer noch seine Grenzen, aber dies ist ein großer Durchbruch bei der gleichzeitigen Verwendung großer Sprachmodelle und Computer Vision.Wenn Sie mehr über Visual ChatGPT erfahren möchten, lesen Sie diesen Artikel: Visual ChatGPT: Konversation, Zeichnen und Bearbeiten mit Visual Foundation-Modellen

Ist Visual ChatGPT ChatGPT4 ähnlich? Was denken Sie, wenn Sie beide Methoden ausprobiert haben? Hinterlassen Sie unten einen Kommentar!

Ursprünglicher Link:Visual ChatGPT: Kombination aus Microsoft ChatGPT und VFM (mvrlink.com)