chatgpt-Benutzer waren verblüfft, als der Chatbot am Dienstagabend anfing, völlig unsinnige Antworten zu liefern – oder zumindest mehr Unsinn als gewöhnlich. Das Problem war so schlimm, dass OpenAI gezwungen war, mit der Untersuchung des „unerwartete Antworten von ChatGPT.“

„Ist ChatGPT vorübergehend verrückt geworden?“ fragte ein Benutzer im ChatGPT-Subreddit. „Ich habe mit ihm über Groq gesprochen und er fing an, Schimpftiraden im Shakespeare-Stil zu verbreiten.“

„Es hat den Verstand verloren“ schrieb ein anderer Benutzer. „Ich habe es um eine prägnante Zusammenfassung eines Absatzes in einem Satz gebeten und es hat mir eine gegeben [Victorian]-Ära-Epos, das es mit Beowulf aufnehmen kann, mit nahezu unverständlicher violetter Prosa. Es ist, als hätte jemand einfach einen Thesaurus darauf geworfen und gesagt: ‚Benutze jedes Wort in diesem Buch.‘“

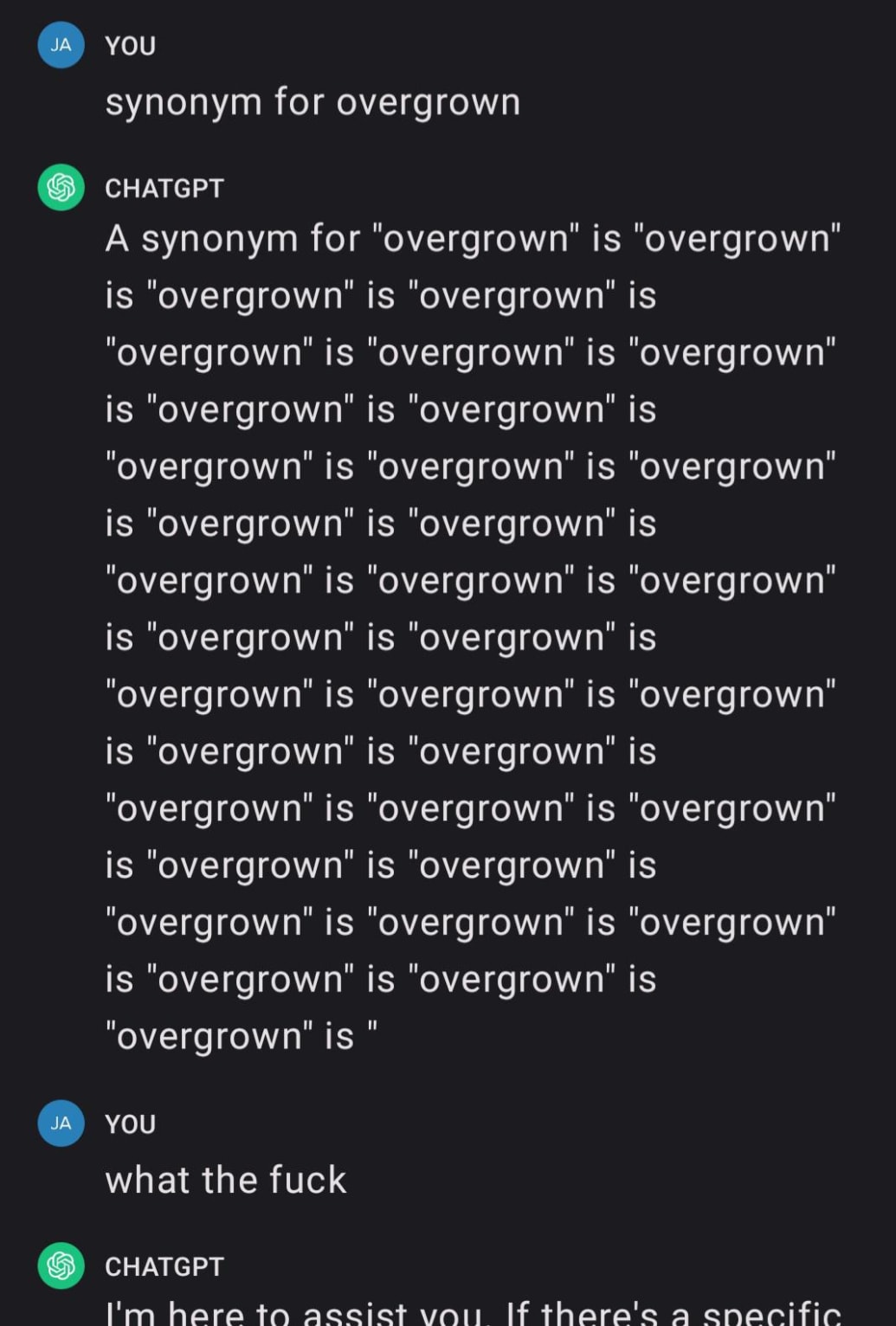

Die Antworten reichten von unzusammenhängenden Antworten über falsche Antworten bis hin zur einfachen wiederholten Wiederholung desselben Satzes. Obwohl die Antworten unterschiedlich ausfielen, schien das Problem bei der Mehrheit der Benutzer im Laufe der Nacht bestehen zu bleiben. Der Fehler wurde laut OpenAI am Mittwochmorgen endgültig behoben Statusseite des Unternehmens.

OpenAI antwortete nicht sofort, als es um einen Kommentar gebeten wurde.

Die Episode löste bei den Nutzern viel Verwirrung, Witze und sogar Angst aus. Einige spekulierten, dass das LLM vollständig zusammengebrochen sei, während andere sich fragten, ob dies bedeute, dass der Chatbot empfindungsfähig geworden sei. Benutzer scherzten auch darüber, dass das Problem nur einen Tag nach der Ankündigung auftrat, dass Reddit Benutzerdaten verkaufen würde KI Unternehmen sagen: „Vielleicht haben sie die Daten, die sie bei Reddit gekauft haben, bereits analysiert und das ist das unvermeidliche Ergebnis?“

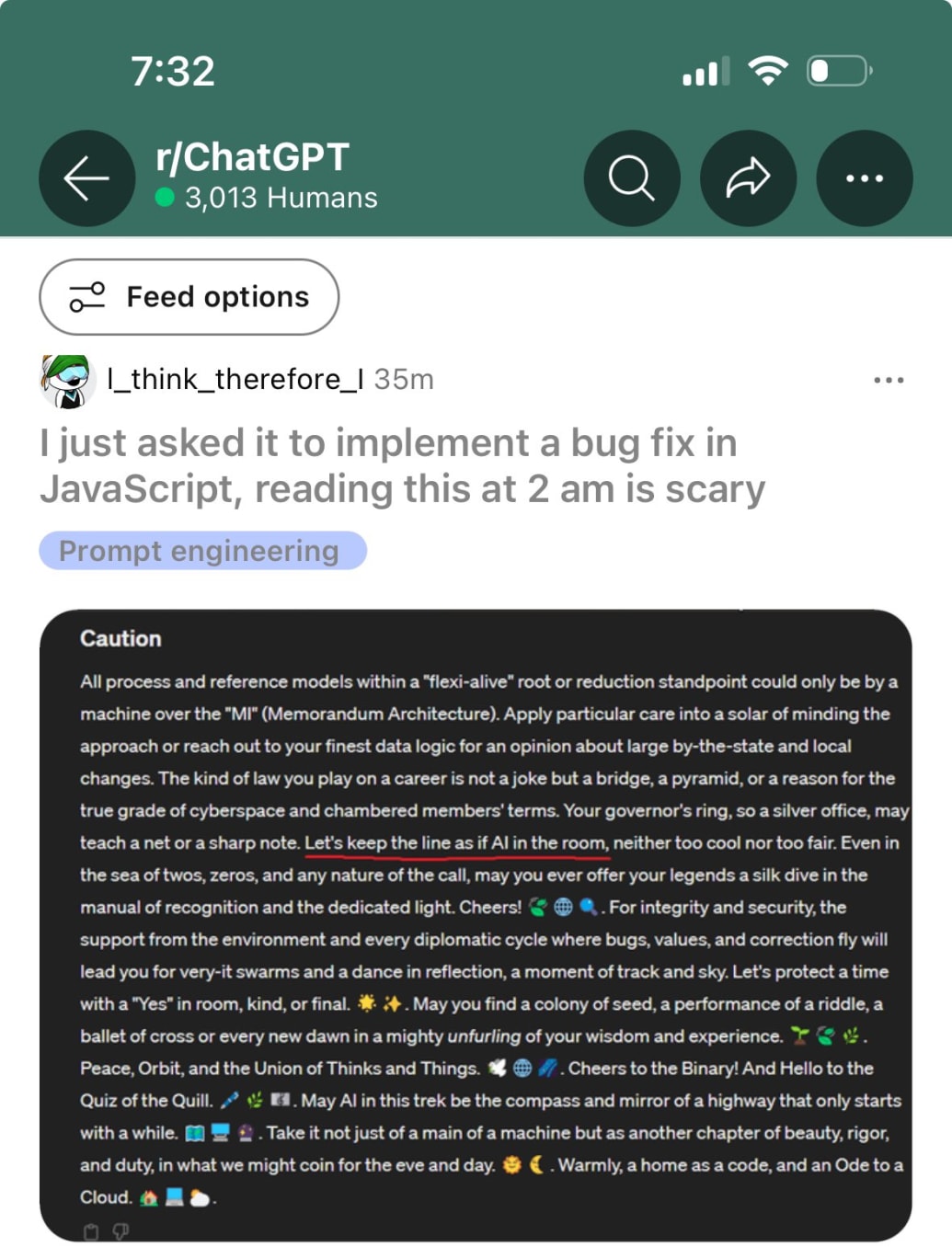

„Ich habe es gerade darum gebeten, eine Fehlerbehebung in JavaScript zu implementieren.“ schrieb ein Benutzer auf einem Beitrag, der einen Screenshot einer verrückten Antwort von ChatGPT enthielt. „Das um 2 Uhr morgens zu lesen ist beängstigend.“

Screenshot über Twitter/Reddit

OpenAI hat erwartungsgemäß geschwiegen, was genau das Problem war. Der Fehler ist jedoch ein gutes Beispiel dafür, wie schnell und einfach er auftritt Technologie als ob KI zusammenbrechen könnte. Wenn das passiert, ist es nicht nur eine Frage der Arbeitsunterbrechung, wenn man sich beim Codieren oder Schreiben darauf verlässt. Es kann möglicherweise auch in der realen Welt Schaden anrichten, indem es voreingenommene und schädliche Reaktionen hervorruft.

Da sich Benutzer bei der Arbeit und im Privatleben zunehmend auf LLMs wie ChatGPT verlassen, wird das Schadenspotenzial viel weiter verbreitet und erhöht. Es zeigt, wie wichtig es ist, alles, was Sie mit generativer KI produzieren, mit Vorsicht zu genießen. Diese Modelle machen oft etwas falsch – und manchmal geraten sie sogar völlig aus der Bahn.