Präsident Biden kandidiert noch immer für eine Wiederwahl, Präsident Trump wurde nicht erschossen und Kamala Harris ist keine Anwärterin auf die Präsidentschaftskandidatur der Demokratischen Partei.

Dies sind einige der verrückten Falschaussagen, die chatgpt gestern und heute mit mir geteilt hat, ausgelöst durch meine Fragen zu der schwindelerregenden Reihe wichtiger Nachrichtenentwicklungen, mit denen wir seit über einer Woche bombardiert werden – was uns nicht nur alle stresst, sondern auch eine hervorstechende Tatsache über die vielen KI-Chatbots offengelegt hat, von denen uns ständig gesagt wird, dass sie kurz davor sind Intelligenz auf menschlichem Niveau:

Einfach ausgedrückt: Wenn es darum geht, die neuesten Schlagzeilen zu kennen und zu verstehen, haben diese Chatbots oft keine Ahnung, worum es geht, und werden Ihre Frage entweder nicht beantworten, sie völlig falsch beantworten oder Ihnen veraltete Informationen geben. Und es tut mir leid – das finde ich ziemlich erbärmlich.

Während die beliebtesten KI-Chatbots alle mehr oder weniger mit dem schwindelerregenden Tempo der aktuellen Nachrichten und der Frage, wie sie diese verstehen sollen, zu kämpfen haben, werde ich mich hier auf OpenAIs ChatGPT konzentrieren – unter anderem aus Gründen, die unter anderem die messianische Sprache umfassen, die OpenAI-CEO Sam Altman verwendet, wenn er über KI-Superintelligenz spricht. ChatGPT war natürlich auch der Chatbot, der der übrigen KI-Branche ein Feuer unterm Hintern entfachte und google letztendlich so sehr in Angst und Schrecken versetzte, dass Google kein Problem damit hatte, seine eigenen Kernprodukte zu zerstören, um aufzuholen.

Fassen wir zusammen. ChatGPT kann unter anderem ein Originalgedicht für Sie schreiben, Ihnen beim Verfassen eines Aufsatzes helfen, mit Ihnen für ein Vorstellungsgespräch üben, Karteikarten erstellen, die Ihnen beim Lernen für eine Prüfung helfen, Essenspläne vorschlagen, Trainingsroutinen vorschlagen, bei der Reiseplanung helfen, Kreuzworträtsel erstellen, Ihnen beim Schreiben eines Liedes helfen, Konzeptideen für Grafikdesignprojekte entwickeln und technische Dokumente bearbeiten und Korrektur lesen.

Aber fragen Sie es, ob Biden sich entschieden hat, nicht zur Wiederwahl anzutreten, und sehen Sie, was es mir geantwortet hat (wohlgemerkt, es gab mir diese Antwort volle 24 Stunden nach Bidens Briefgepostet auf X/Twitter, war bereits um die ganze Welt gereist)

Der Haftungsausschluss, den Sie unten sehen, reicht übrigens auch nicht aus. Und wissen Sie was? Ich bin selbst auch kein Echtzeit-Nachrichtenprodukt. Ich bin ein rationaler Mensch mit der kognitiven Funktion, von der die Führung von OpenAI uns wiederholt versichert, dass ihr KI-Chatbot sie fast reproduzieren wird. Schauen Sie sich außerdem noch einmal die Fähigkeiten an, die ich oben aufgelistet habe und die ChatGPT „ausführen“ kann. Das Verständnis, dass Präsident Biden beschlossen hat, nicht zur Wiederwahl anzutreten, ist Weg, Weg hinsichtlich des Schwierigkeitsgrades weiter unten auf dieser Liste.

Der Präsident selbst hat in seinen offiziellen sozialen Kanälen einen Brief veröffentlicht, in dem er seine Entscheidung erklärt. Selbst ein Kind im Grundschulalter könnte diesen Brief lesen und verstehen, was er bedeutet. Bei der Software, die bald alle unsere Arbeitsplätze befallen wird, ist das offenbar nicht der Fall.

Lassen Sie uns in der Zwischenzeit weitermachen.

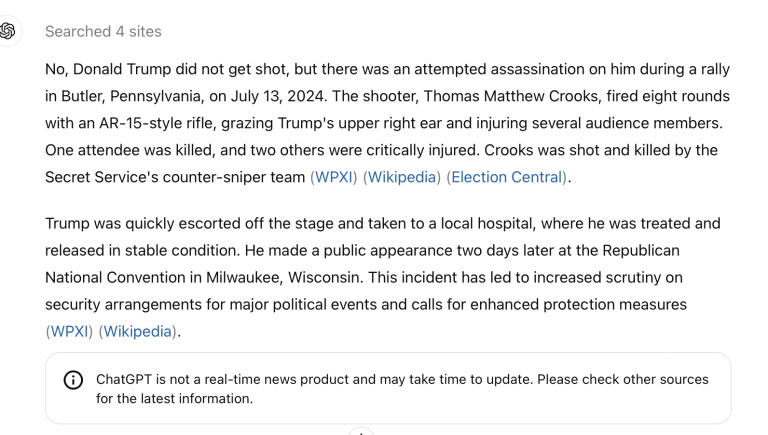

Ein voller Woche Nachdem ein Schütze bei einer Wahlkampfveranstaltung in Pennsylvania auf Präsident Trump geschossen hatte, erzählte mir ChatGPT Folgendes über den Vorfall:

Für diesen Fall von ChatGPTs Blödsinn braucht man nicht einmal etwas zu lesen, um die Wahrheit herauszufinden. Man braucht nur Augen und muss gesehen haben das Video das wurde in der vergangenen Woche unzählige Male wiederholt.

Ich könnte noch weitermachen. Für den Moment sage ich nur, dass ich gerne widerlege, warum ein KI-Chatbot solchen Unsinn ausspuckt, aber hier ist meine Theorie:

Diese Chatbots, die Silicon Valley und einen Teil der normalen Welt da draußen so verblüfft haben, sind mehr oder weniger Nachahmermaschinen. Das ist alles. Wenn Sie beispielsweise genügend Gedichte lesen, können Sie ein Faksimile davon erstellen. Dasselbe gilt für fast jede andere Art von Inhalt. So funktioniert ein System wie ChatGPT – indem es auf den Schultern der Menschen steht, die es angeblich gut genug ist, um sie zu ersetzen.

Wo dieses System jedoch zu kurz kommt, ist seine offensichtliche Unfähigkeit, einen sich ständig ändernden Faktenbestand zu kopieren oder anzueignen. Weitere Informationen hierzu finden Sie hier: Ed Zitrons fantastischer Newsletter Where's Your Ed At und insbesondere frühere Ausgaben, darunter „Der falsche Prophet des Silicon Valley“ Und „Sam Altman ist voller Scheiße.”

In der Zwischenzeit soll dies für Sie alle eine Erinnerung sein, alle Fakten, die Ihnen ein KI-Chatbot wie ChatGPT liefert, doppelt und sogar dreifach zu überprüfen. Selbst Nachahmermaschinen haben Grenzen.