chatgpt ist seit seiner Einführung im November 2022 die führende Plattform für künstliche Intelligenz. In dieser Zeit gab es neue Modelle und regelmäßige Updates der Benutzeroberfläche – aber hat OpenAI einige Upgrades hinter den Kulissen an GPT-4o vorgenommen, die es reaktionsschneller gemacht haben?

Ich habe in letzter Zeit viel Zeit damit verbracht, mit Anthropics Claude zu arbeiten. Es ist kein Geheimnis, dass ich ein großer Fan der Artefakte und der Art und Weise bin, wie das Claude-Modell reagiert. Es ist in seiner Ausgabe oft detaillierter, versteht, was ich von einer einzigen Eingabeaufforderung aus verlange, und ist dank Sonnet 3.5 schneller.

Ich wechsle jedoch regelmäßig zwischen den Plattformen, darunter Llama auf Groq, google Gemini und die vielen auf Poe verfügbaren Modelle. Vor kurzem ist mir aufgefallen, dass ChatGPT genauso gut geworden ist wie Claude mit Sonnet 3.5, als es zum ersten Mal auf den Markt kam – insbesondere bei längeren Aufgaben.

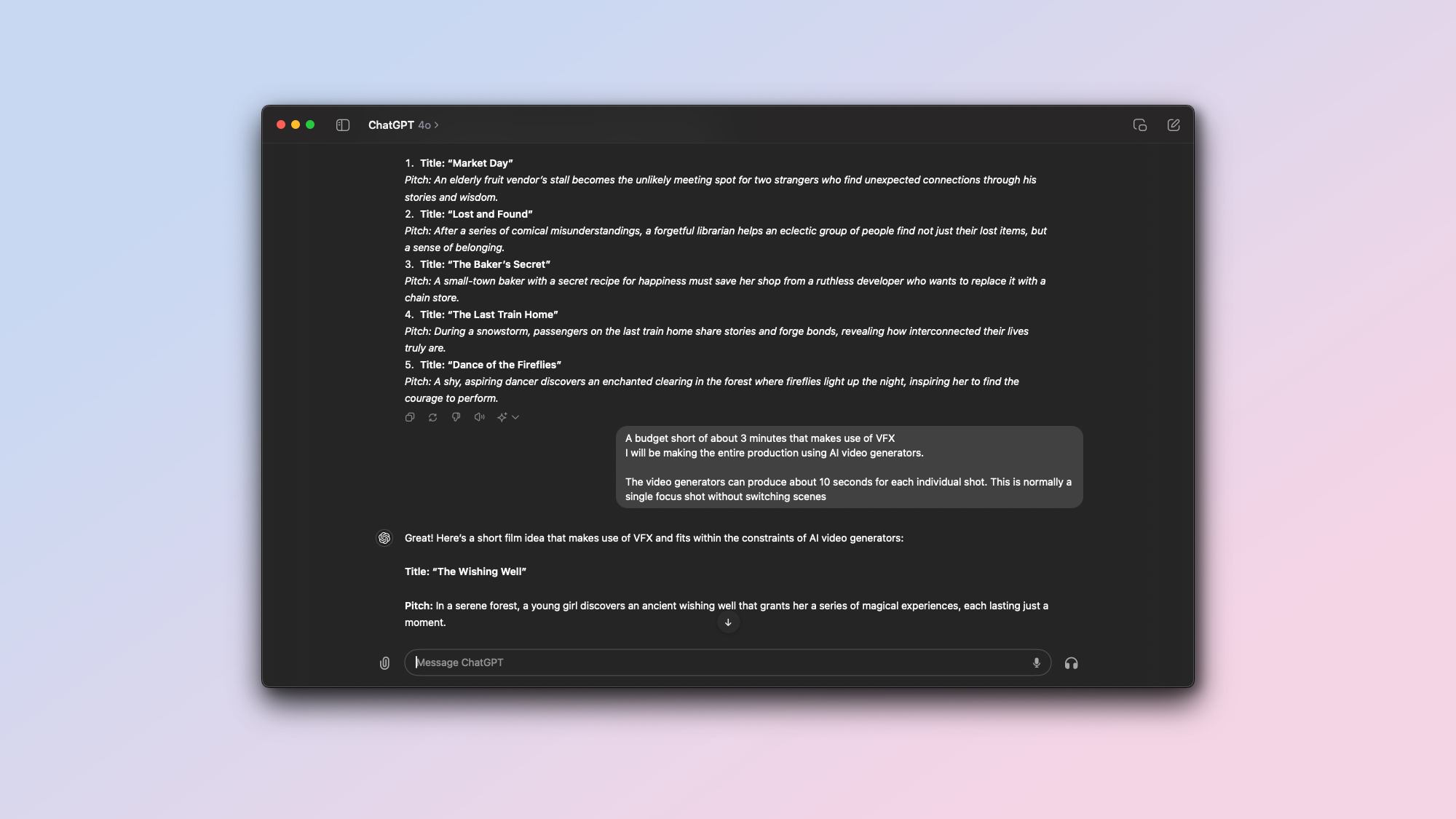

Allein in der letzten Woche habe ich mit ChatGPT in einer Stunde eine komplette iOS-App erstellt, mehrere Briefe umgeschrieben und Shot-by-Shot-Pläne für KI-Videoprojekte erstellt – ohne dass ChatGPT ins Schwitzen kam. Es bearbeitet jede Abfrage ohne zu stolpern, ist sehr schnell und kreativer.

Was hat sich in ChatGPT geändert?

Während neue Modelle von OpenAI wie GPT-4o die ganze Aufmerksamkeit auf sich ziehen, veröffentlicht das Unternehmen häufig eine optimierte Version eines bestehenden Modells, die einen großen Einfluss auf die Leistung haben kann. Diese erhalten außerhalb von Entwicklerkreisen wenig Aufmerksamkeit, da sich die Beschriftung in ChatGPT nicht ändert.

Letzte Woche wurde GPT-4o aktualisiert und ein neues Modell namens GPT-4o-2024-08-06 für Entwickler veröffentlicht. Das Hauptversprechen waren günstigere API-Aufrufe und schnellere Antworten, aber jedes neue Update bringt auch allgemeine Verbesserungen durch Feinabstimmung mit sich.

Diese Updates wurden wahrscheinlich auch für ChatGPT bereitgestellt – schließlich ist es für OpenAI sinnvoll, in seinem öffentlichen Chatbot die am günstigsten zu betreibende Version von GPT-4o zu verwenden.

Dies mag zwar nicht so glamourös sein wie ein GPT-4o-Start, hat aber zu subtilen Verbesserungen geführt. Ich vermute, dass es auch ein Element von Back-End-Änderungen an der Infrastruktur gibt, die längere Ausgaben und schnellere Reaktionen ermöglichen, die über die bloßen Modellaktualisierungen hinausgehen.

Es fühlt sich schneller und kreativer an

Ich stütze mich dabei ausschließlich auf meine eigenen Erfahrungen mit ChatGPT in der letzten Woche. Ich habe ihm die gleichen Abfragetypen angeboten, die ich bei Claude und bei ChatGPT verwendet habe, und es „fühlt“ sich schneller an.

Ein Beispiel hierfür ist die Handhabung sehr langer Codeblöcke. Ich habe eine ToDo-Listen-App für das iphone erstellt, die Gamification verwendet, um die Erledigung von Aufgaben zu fördern. Dies erfordert oft mehrere Nachrichten für jeden Codeblock, und wenn der Codeblock zu lang war, hat ChatGPT in der Vergangenheit eine Antwort abgeschnitten.

Es wird erwartet, dass Sie Elemente herausziehen und in Ihrem eigenen Code ersetzen. In letzter Zeit hat ChatGPT bei jeder Aktualisierungsanforderung ganze Codeblöcke angezeigt, ohne dass Sie dazu aufgefordert wurden.

ChatGPT führt dies über mehrere Nachrichten aus, verwendet dabei jedoch die sehr clevere Funktion „Weiter generieren“, sodass alles in einem einzigen Codeblock angezeigt wird und nicht unzusammenhängend über mehrere Nachrichten verteilt, wodurch häufig das Layout oder die Struktur des Codes beschädigt wird.

Ich habe auch festgestellt, dass es bei Aufgaben wie „Überlege dir fünf Ideen für einen Kurzfilm über ganz normale Leute“ oder „Schreibe diesen Brief für eine bestimmte Zielgruppe neu“ kreativer reagiert.

Ich kann zwar nicht mit Sicherheit sagen, dass es ein Upgrade für ChatGPT gegeben hat, aber die Leistung ist im Vergleich zu vor etwa zwei Wochen auf jeden Fall besser geworden – und ich verwende es häufiger als seit langem.