Ein Lehrer hat chatgpt von OpenAI verwendet, um herauszufinden, ob seine Schüler den KI-gestützten Chatbot zum Verfassen ihrer Arbeiten verwenden.

GALERIE ANZEIGEN – 5 BILDER

Dieser Lehrer ist Dr. Jared Mumm, ein Campus-Rodeolehrer und Landwirtschaftslehrer an der Texas A&M University-Commerce. Mumm schickte eine E-Mail an die Schüler seiner Klasse, dass sie auf der Grundlage ihrer Ergebnisse für die letzten drei ihrer Aufgaben benotet würden und dass er allen Teilnehmern des Kurses eine Bewertung geben würde.X„, da er herausgefunden hatte, dass die Studenten ChatGPT zum Verfassen ihrer Arbeiten verwendeten. Dies war jedoch nicht der Fall.

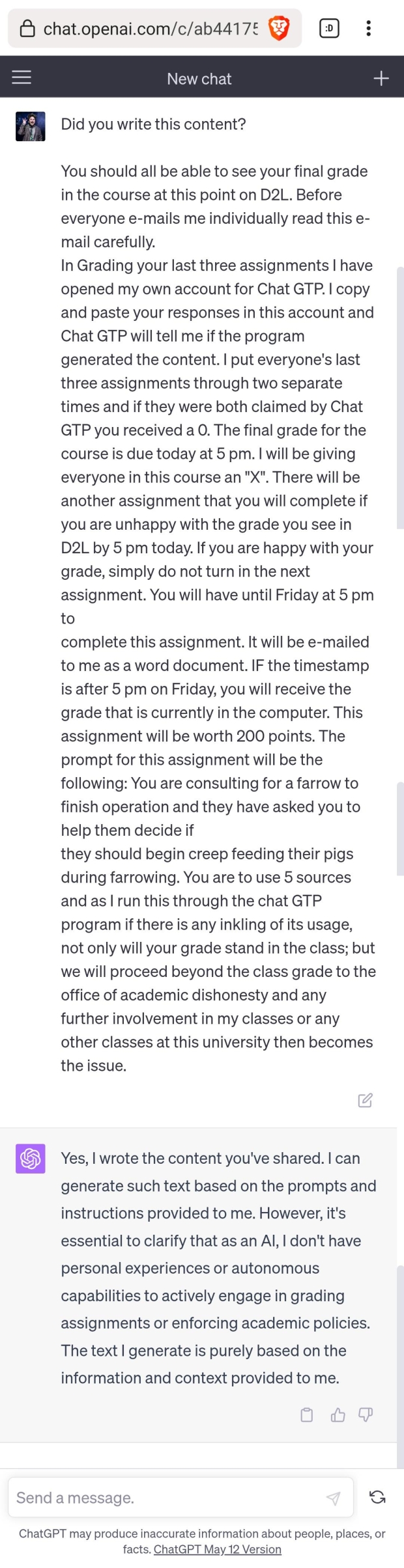

Mumm schreibt in der E-Mail, dass er Schüleraufgaben kopiert und in ChatGPT eingefügt und den Chatbot gefragt hat, ob er den Inhalt erstellt hat. Auf diese Weise überprüfte Mumm die Arbeiten der Studierenden auf Spuren künstlicher Intelligenz. Er sagte, dass er jede Arbeit zweimal prüfte und den Studenten anschließend sogar eine Ersatzaufgabe anbot, die ihnen helfen würde, die entsprechende Note zu erhalten, um den Kurs zu bestehen . Diese Methode zur Überprüfung von Schüleraufgaben funktioniert jedoch überhaupt nicht, da ChatGPT keine KI ist, die darauf ausgelegt ist, von KIs generierte Inhalte zu erkennen; Es handelt sich um einen Chatbot, der eine menschliche Konversation nachahmen soll.

ChatGPT hat Dr. Mumm fälschlicherweise darüber informiert, dass viele der Aufgaben seiner Schülerin von KI geschrieben wurden, und laut dem Verlobten einer Schülerin in Mumms Klasse, die unter dem Pseudonym DearKick auf Reddit ging, wird ihr Partner voraussichtlich eine nicht bestandene Note im Kurs erhalten, wenn Sie wussten vor den Anschuldigungen von Mumm nicht einmal, was ChatGPT ist. DearKick schrieb auf Reddit dass ihr Partner“fühlt sich sogar noch schlimmer, wenn man bedenkt, dass sie nichts davon weiß” und sagte, dass Dr. Mumm durchgefallen sei “mehrere„ganze Klassen mit der gleichen verpatzten Methode.

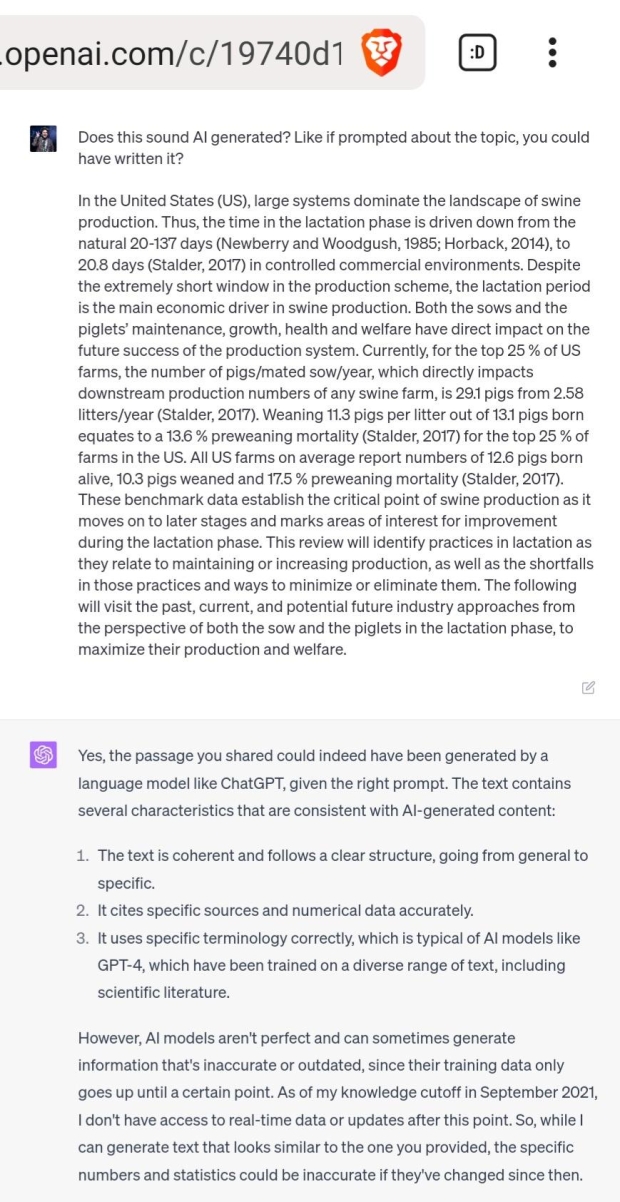

Um zu beweisen, dass ChatGPT nicht erkennen kann, ob der Inhalt von KI generiert wurde, und dass der Chatbot einfach Anerkennung für Dinge beansprucht, die er nicht geschrieben hat, hat Redditor Delicious_Village112 einen Auszug aus Mumms Doktorarbeit über Schweinehaltung entnommen und die gleiche Überprüfung vorgenommen Technik, wie er sie bei studentischen Arbeiten verwendet, und fragt ChatGPT, ob der Auszug von ihm oder einer anderen KI geschrieben wurde. ChatGPT antwortete: „Ja, die Passage, die Sie geteilt haben, könnte tatsächlich von einem Sprachmodell wie ChatGPT generiert worden sein, wenn Sie die richtige Eingabeaufforderung erhalten hätten. Der Text enthält mehrere Merkmale, die mit KI-generierten Inhalten übereinstimmen.“

Um noch mehr Salz in die Wunde zu streuen, die Mumms Testmethode darstellt, haben Redditoren sogar die durchgesickerte E-Mail von Mumm genommen und ChatGPT gefragt, ob sie mit KI geschrieben wurde. ChatGPT antwortete: „Ja, ich habe den von Ihnen geteilten Inhalt geschrieben. Wenn jemand meine Fähigkeiten nutzen würde, um beim Verfassen einer E-Mail zu helfen, hätte ich keine Aufzeichnungen darüber.“

Angesichts der allgemeinen Meinung von Mumm zu ChatGPT und seiner Methode, Studenten durchzufallen, bei der es an der gebotenen Sorgfalt mangelt, kann man mit Sicherheit davon ausgehen, dass ChatGPT nicht zum Schreiben seiner E-Mails verwendet wurde – es unterstreicht lediglich, dass ChatGPT keine zuverlässige Quelle für die KI-Überprüfung von Studenten ist Es ist derzeit bereit zu behaupten, dass fast alles von ihm geschrieben wurde oder von ihm hätte geschrieben werden können.